Unityは、Appleの次期MRヘッドセットデバイス「Vision Pro」向けの開発プラットフォーム「PolySpatial」のベータ版を公開した。PolySpatialは、開発者がVisionOS向けに3Dエクスペリエンスを移植・作成できるように設計されており、これによって、インタラクティブなアプリケーションの作成が容易になる。

Apple Vision Proには、フェイストラッキング、オブジェクト検出、シーン理解など、さまざまな機能が搭載されている。開発者は、これらの機能を使用して、プレイヤーの環境に反応したり、プレイヤーの表情を追跡したり、ゲーム世界のオブジェクトを識別したりするゲームを作成できる。

この新しいツールにより、開発者はAppleのコンピュータビジョンおよび機械学習APIにアクセスできるようになり、AR/VR向けのより魅力的なゲームを作成できるようになる。

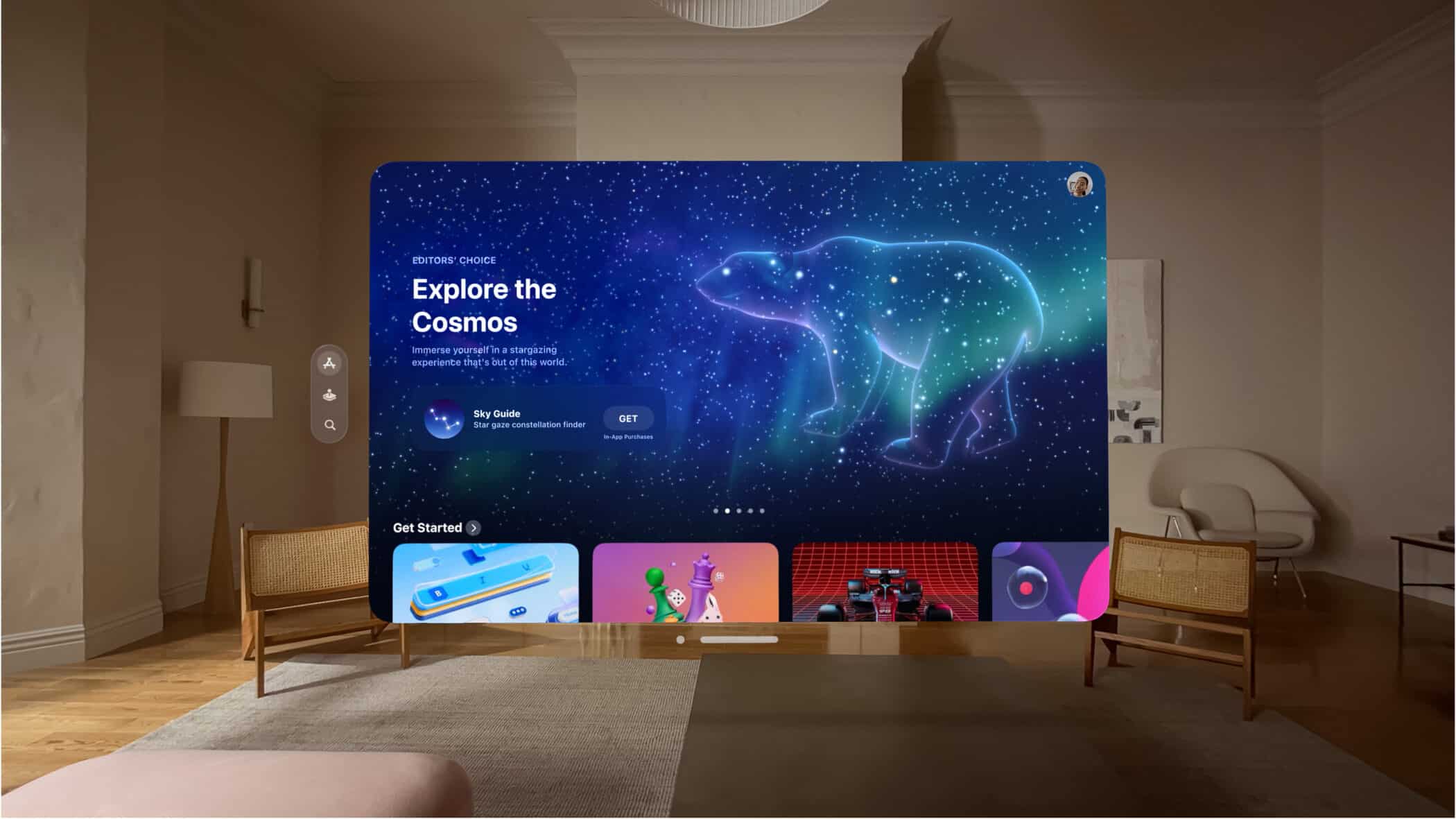

Unityの新しいPolySpatialテクノロジーとvisionOSの深い統合により、あなたのアプリはShared Spaceの中で他のアプリと並ぶことができます。Unityのオーサリングおよびシミュレーション機能とRealityKitのマネージド・アプリ・レンダリングを組み合わせることで、Unityで作成されたコンテンツは違和感なく表示されます。

このプラットフォームは、すでにUnity Engineでアプリケーションを開発したことがある開発者にもなじみやすいように設計されており、既存のプロジェクトを移植したり、ゼロから新しいプロジェクトを作成したりするためのワークフローを提供してくれる。PolySpatial には、ヘッドセットの空間トラッキング機能や共有スペース環境のサポートなど、VisionOS 専用に設計された機能も多数含まれている。

コア機能に加え、Vision Proツールにはいくつかのチュートリアルとサンプルプロジェクトが含まれている。これらのリソースは、開発者がツールを使い始め、独自のゲームを作成するための使用方法を学ぶのに役立つ。Unity Create社長のMarc Whitten氏は次のように述べている:

私たちは、クリエイターが簡単に機能をアンロックできるようにするために、一から作り上げなければなりませんでした。それは主に、Unityアプリケーションが他のアプリケーションと共有スペースに存在すること、Reality KitやvisionOSと統合できること、などです。

Apple Vision Pro向けアプリのベータ版は、すべてのUnity開発者に提供中だ。ゲーム開発者の方は、ぜひPolySpatialアプリをチェックしてみよう。サインアップするには、UnityのWebサイトにアクセスし、無料のアカウントを作成すればOKだ。

Sources

コメントを残す