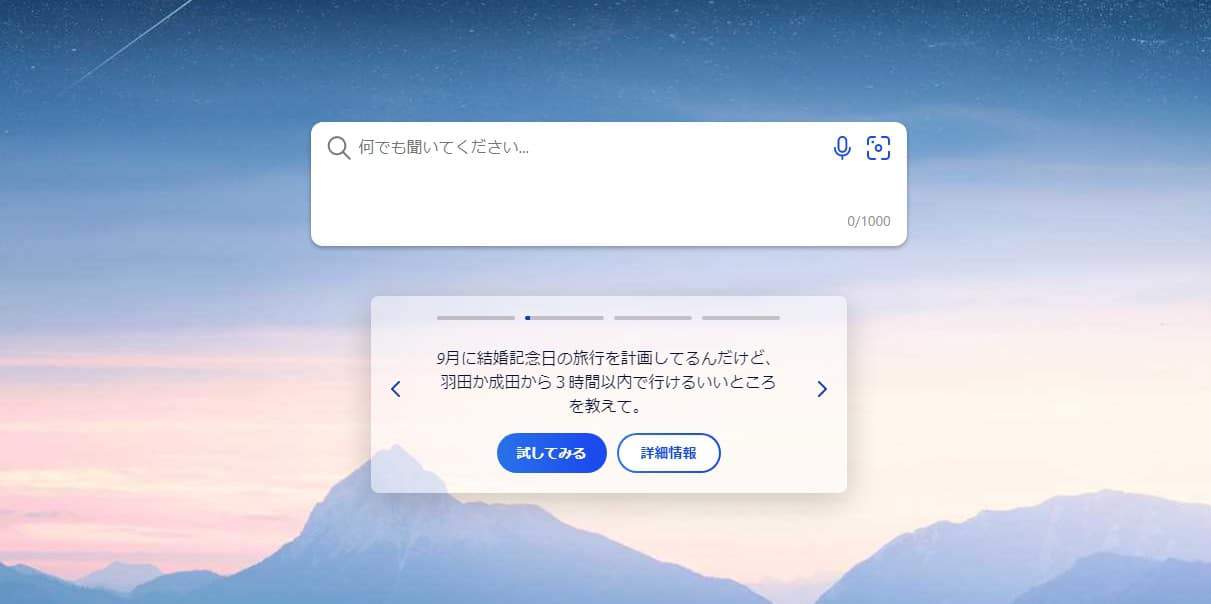

Microsoftは、BingのAIチャットボットと行える「チャットターン」の回数を、1セッションあたり5回、全体で1日あたり50回に制限する事を発表した。各チャットターンは、あなたの質問とBingの回答からなる会話のやり取りで、5回を超えるとチャットボットが限界に達したことが伝えられ、新しい話題を始めるように促されるという。同社は発表の中で、「長時間のチャットセッションは 、新しいBingの基礎となるチャットモデルを混乱させる傾向がある」としており、そのため、Bingのチャット体験に上限を設けていると述べています。

実際、Bingチャットボットが利用可能になって以来、人々はチャットボットによる、おかしな行動を報告してきた。それこそ、プロンプト・インジェクションと呼ばれる方法によって、本来ならば開示してはいけない情報を開示させることや、不穏な返答、狂った返答を行うなどが報告されている。

これらの報告を受けて、Microsoftは、Bingの奇妙な動作を説明するブログ投稿を公開した。それによると、「15問以上の長いチャットセッションで、Bingは繰り返しになったり、必ずしも有用ではない、または私たちのデザインしたトーンに沿った応答をするように促されることがあること」を発見したとのことだ。そして、この問題に対処するためにチャットセッションを制限したという。 しかし、同社はそれがユーザーからのフィードバックを得るために続けているように、将来的にはチャットセッションの上限を拡大することを検討するとも付け加えている。

Source

- Microsoft Bing Blogs: The new Bing & Edge – Updates to Chat

コメントを残す