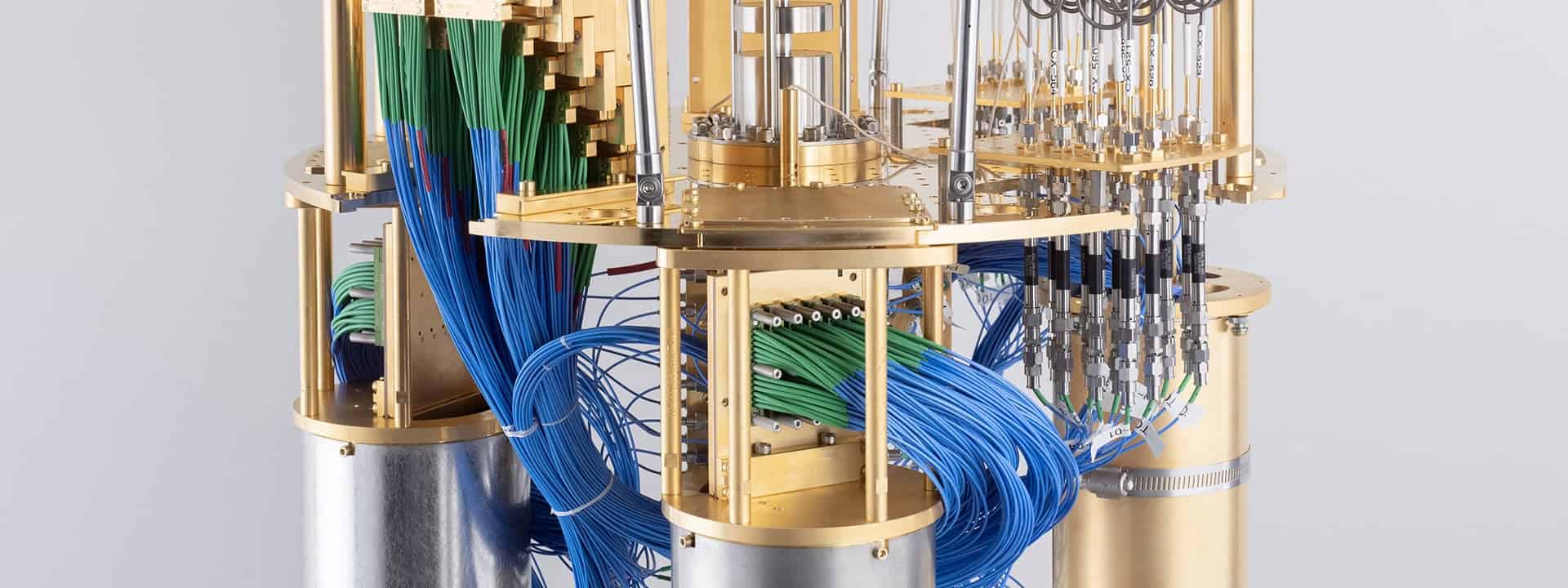

2023年はAIが世界を席巻したが、2024年はIBMの最新イノベーションによって量子コンピューティングの時代が到来するかも知れない。

現代のコンピューティングでは、トランジスタによって、電気のオンオフを数字の1か0に対応させることで、ビットを表現している。しかし、量子コンピューティングでは、量子力学のクセを利用し、分子、イオン、原子、あるいは電子などの素粒子である量子ビットが、「重ね合わせ」として知られる複数のエネルギー状態で同時に存在できるようにする。量子ビットの特定の状態を測定しようとすると、重ね合わせは破壊されるが、この現象には、すべての可能なエネルギー状態に対する確率曲線が含まれる。量子コンピュータは、この確率曲線を利用して、古典的なコンピュータよりも桁違いに高速な計算を行うことができる。

現在の量子プロセッサーは、エラーが発生しやすい。その確率は多くの場合1パーセント以下と小さいが、各量子ビットの状態を読み取るなどの基本的な操作を行うたびに、かなりのエラー率が発生するのである。多くの量子ビットを必要とする演算や、少ない量子ビットに対して多くの演算をしようとすれば、エラーは避けられない。

長期的には、エラー訂正された量子ビットを使ってそれを解決しようと考えている。しかし、そのためには、1ビットの情報に対して複数の高品質な量子ビットが必要になる。つまり、現在作れるものよりも優れた量子ビットが何千個も必要なのだ。そのような状況に達するのは、早くても今後10年後であり、その間に量子コンピュータは全く実用には適さないのだろうかという疑問が生じる。

IBMの研究者は、本日発行された『Nature』誌の中で、これに関する根本的な解決の方法を示している。IBMの研究者は、「エラー緩和」と呼ばれる技術を使って、現在の量子ビットの問題点を克服し、システム内のノイズにもかかわらず正確な結果を出すことに成功した。しかも、古典的なコンピュータで行う同様の計算を明らかに凌駕する方法で行ったのである。

ノイズを受け入れる

2021年11月、IBMは127量子ビットの量子プロセッサー「Eagle」を発表した。本日、IBMがUCバークレーと共同で開発し発表した新しいアプローチは、このIBMのEagle量子コンピュータのノイズを効果的に打ち消し、実世界での応用を生み出すものだ。

量子エラー訂正を、量子ビットの正確な演算を妨げるノイズを回避する方法と考えると、エラー緩和は、ノイズが不可避であることを受け入れることだと考えることができる。典型的な誤差を測定し、その誤差を事後的に補正して、ノイズの中に隠れている本当の結果を推定する手段なのだ。

初期のエラー緩和法(確率的エラーキャンセル法)は、量子プロセッサの動作をサンプリングして典型的なノイズのモデルを作成し、実際の計算で計測した出力からノイズを差し引くというものだった。しかし、計算に関わる量子ビットの数が増えると、この方法ではサンプリングが多すぎて実用的ではない。

そこで研究者たちは、プロセッサのノイズを意図的に増幅し、さまざまなレベルで測定する方法を採用した。この測定値をもとに、実際の測定値と同じような出力が得られる関数を推定するのだ。そして、その関数のノイズをゼロに設定することで、ノイズがない場合のプロセッサの動作を推定することができるのだ。

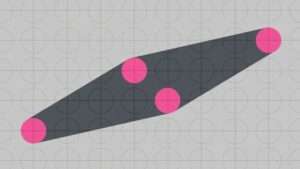

このシステムをテストするために、研究者たちはイジングモデルと呼ばれるものを使用した。イジングモデルは、電子のグリッドと考えるとわかりやすく、各電子のスピンが隣の電子のスピンに影響する。時間を進めると、隣の電子の影響を受けてスピンが変化し、グリッド全体の状態が変化する。そして、新しいスピンの配置が互いに影響し合い、時間の経過とともにこのプロセスが繰り返される。

イジングモデルは、単純化された理想的な振る舞いをするが、さまざまな物理系で見られる特徴を持っているため、かなり広く研究されている。また、モデル内の物体の数が増えると、その挙動はすぐに複雑化し、古典的なコンピュータではその状態を計算するのに苦労するようになる。

量子コンピュータでは、量子ビットのペアに対して演算を行うことで、その計算を行うことが出来る。IBMは、問題を単純化するために、プロセッサー上の量子ビットの物理的配置と一致するようにグリッドが構成されたイジングモデルを使用した。しかし、これは単にプロセッサの動作をモデル化するために使われたのではなく、前述のように、イジングモデルは量子ハードウェアとは無関係に存在する。

量子と古典の比較

まず、研究者たちは、従来のコンピュータで計算できるように、モデル化するスピンの数を制限した。ノイズを補正すると、量子計算で得られた数値は、十数回の時間ステップを経ても、古典計算で得られた数値と一致した。しかし、古典計算機(64コアのプロセッサーと128GBのメモリー)が苦戦し始めるところまでモデルをスケールアップするのは比較的簡単だった。

これは、このシステムをモデル化するのに68個の量子ビットが必要になった時点で起こった。そこで研究者たちは、古典的なコンピュータ上でシステムの挙動を推定するソフトウェアを使用し、精度を犠牲にしながらも、より長い時間維持することができた。それでも、127量子ビットが必要な段階までモデルの規模を拡大することができたが、これは古典的な計算では追いつかないレベルだ。

研究者は、20回のタイムステップを経てシステムの動作をトレースするには、400ペタバイト以上のメモリが必要だと見積もっています。

つまり、量子コンピュータが、潜在的に興味深い問題において、古典コンピュータを凌駕する明確な事例であると言える。さらにガンベッタは、イジングモデルのような単純な系でノイズ緩和の効果を示すことは、実用化されうるより複雑な問題にこのアプローチを適用するためには不可欠であると指摘した。しかし、単に量子ビットを増やせばいいというものでもないだろう。

研究者たちは、20回のタイムステップを通してシステムの動作をトレースすると、400ペタバイトを超えるメモリが必要になると見積もっている。

つまり、これは、潜在的に興味深い問題において、量子コンピュータが古典コンピュータを凌駕する明確な事例であるように思われる。

IBMは400以上の量子ビットを持つ量子プロセッサーを持っているが、なぜここで使う127量子ビットに限定するのだろうか?これにはいくつかの理由がある。IBMが127量子ビットの小型のEagleプロセッサを選んだのは、それがすでにリビジョン3に到達しているからで、大型のOspreyプロセッサはまだ最初のイテレーションだ。この2つのリビジョンで、量子ビットの性能を向上させ、補正すべきノイズを減らしている。

ノイズの補正は計算量が多く、古典的なコンピュータで行う必要があるからだ。量子コンピュータでノイズのサンプリングを行うと、5分ほどしかかからない。しかし、より小さな問題であっても、ノイズの補正に4時間かかり、古典コンピュータで単純にシステムをモデル化すると8時間かかる。さらに、もう少し大きな問題では、モデル化に約30時間かかったのに対し、ノイズの緩和には9.5時間かかっている。

この結果、十分な数の量子ビットを追加することで、エラーミティゲーションを計算不可能にできる可能性があることが分かった。

しかし、IBMはここで楽観視できる理由が2つあると考えています。まず、研究チームによると、エラー緩和に関わるアルゴリズムは、「古典的な処理遅延に支配されており、概念的に単純な最適化によってほとんど解消される見込みです」。つまり、スピードアップが期待できるのです。もうひとつは、量子ハードウェアのエラー率の関数として処理時間が変化することで、エラー率が低ければ古典的な計算が速くなる。

もちろん、これは量子コンピュータの能力が従来のコンピュータの能力を明らかに上回る「量子至上主義」に向けた重要な一歩に過ぎない。しかし、IBMの今回の技術革新は、この夢の実現に大きく近づいたと言えるだろう。

IBMはすでにNVIDIAやSamsungと提携し、従来のシリコンの性能を向上させている事は記憶に新しい。しかし、量子力学の優位性は、コンピューティング・パワーのまったく新しい章を開き、前例のないスピードと効率の向上を実現する可能性がある。

これらのことから、IBMの人々は、エラー訂正された量子ビットが可能になる時点よりずっと前に、量子ハードウェアで有用な計算を行うためのルートとして、エラー緩和を楽観視している。論文の結論として、「ノイズの多い量子プロセッサは、フォールトトレラント量子コンピューティングの出現前であっても、100量子ビットを超えるスケールで信頼できる期待値を生み出し、自明ではない回路深度は、ノイズ制限量子回路から実用的な計算の優位性を引き出すための研究を追求することに実際にメリットがあるという結論に至る」と、ある。

IBMは今年後半に、最も強力な量子プロセッサである1,121量子ビットのCondorチップを発表する予定だ。さらに、最大4,158量子ビットの「実用規模プロセッサー」を開発パイプラインに抱えている。しかし、2033年までに完全にエラー訂正されたアルゴリズムが可能な10万量子ビットのマシンを作るという長期目標を達成するためには、工学的に大きな課題を解決する必要がある。量子コンピュータの進歩は、様々な分野での将来の進歩や応用を期待させるものだ。

論文

参考文献

- IBM:

研究の要旨

量子コンピュータは、ある種の問題において、古典的な計算機よりも大幅な高速化を実現することが期待されている。しかし、その可能性を最大限に発揮するための最大の障害は、量子システムに内在するノイズである。この問題を解決するには、フォールトトレラントな量子回路を実装することが一般的ですが、現在のプロセッサでは実現が困難です。本発表では、ノイズの多い127量子ビットプロセッサを用いた実験を行い、古典的な総当たり計算を超えるスケールで回路体積の正確な期待値を測定することを実証しました。これは、フォールトトレラント以前の時代において、量子コンピュータが有用であることを示す証拠であると主張する。この実験結果は、この規模の超伝導プロセッサのコヒーレンスとキャリブレーションの進歩、およびこのような大規模なデバイス全体のノイズを特徴付け1、制御可能に操作する能力によって可能になりました。測定された期待値は、正確に検証可能な回路の出力と比較することで、その正確さを立証しています。強いエンタングルメントの領域では、量子コンピュータは、純粋な状態に基づく1次元(行列積状態、MPS)および2次元(等積テンソルネットワーク状態、isoTNS)テンソルネットワーク法などの主要な古典近似が破綻する正しい結果を提供しています。これらの実験は、近い将来の量子アプリケーション5を実現するための基礎的なツールを示しています。

コメントを残す