PixArt-Σは、SDXLを大幅に少ないパラメータで凌駕し、商用モデルをも凌駕する。

HuaweiのNoah’s Ark Labと中国の複数の大学の研究者が、先行するオープンソースの画像ジェネレーターPixArt-α(Alpha)とPixArt-δ(Delta)を基にしたテキスト画像変換モデルである「PixArt-Σ(Sigma)」を発表した。このモデルは、これまでの画像ジェネレーターと比較して、大幅に高解像度な画像が生成出来るのだ。

高解像度でプロンプトに忠実な画像を出力

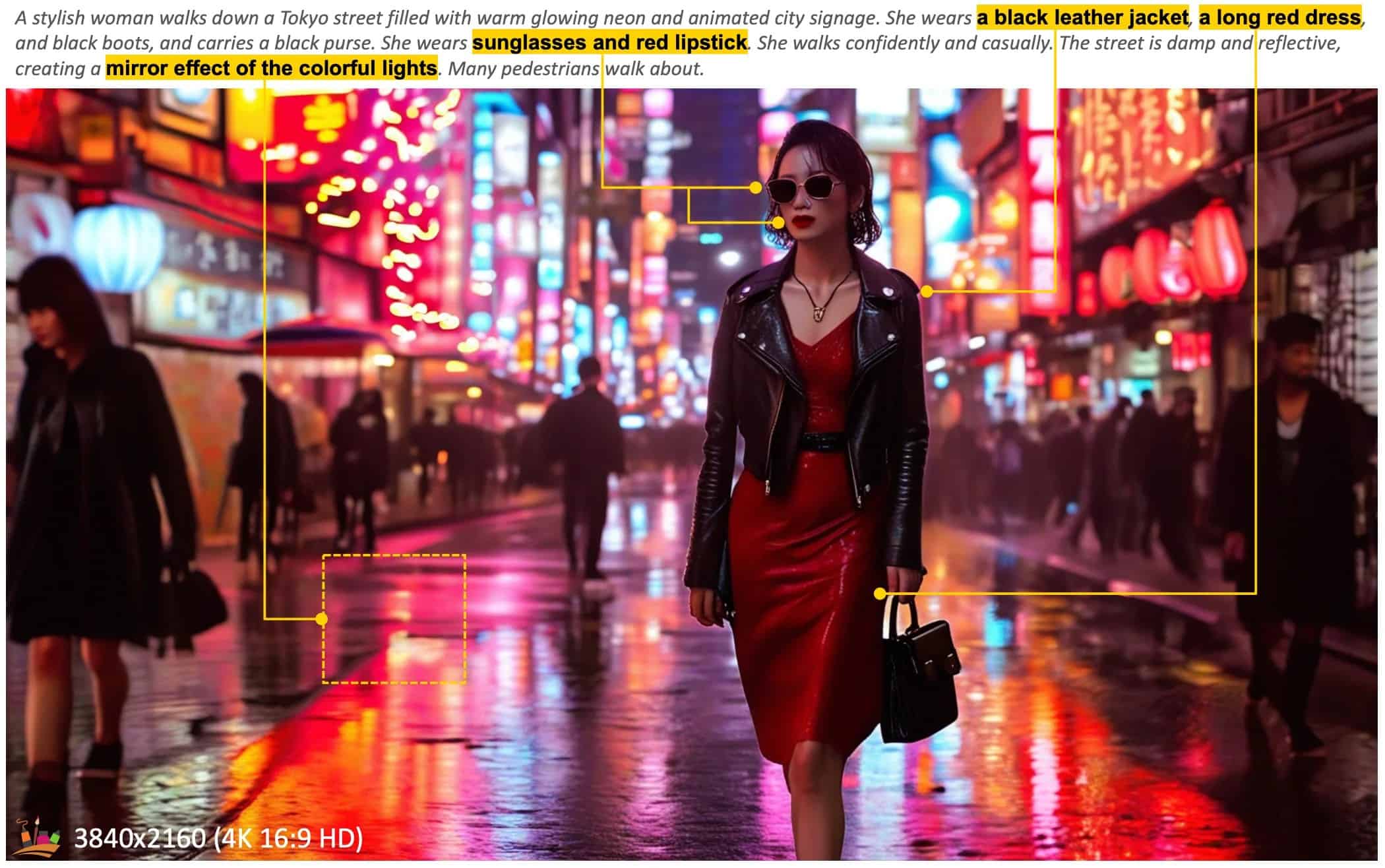

PixArt-Σは、特殊なアスペクト比の画像でも、中間アップスケーラーなしで最大3,840×2,560ピクセルの画像を直接生成することができる。比較すると、従来のPixArtは1,024×1,024ピクセルが限界だった。

解像度が高いほど計算量も多くなるが、研究者たちは「弱いモデルから強いモデルへ」というトレーニング戦略でこれを補おうとしている。この戦略には、「弱いモデルから強いモデルへの高速かつ効率的な移行を可能にする特定の微調整技術が含まれる」、とのことだ。

彼らが使用した技術には、画像をより「理解」する、より強力なバリアブルオートエンコーダー(VAE)の使用、低解像度から高解像度へのスケーリング、キーバリュー圧縮(KV)なしのモデルから、画像の最も重要な側面に焦点を当てたKV圧縮ありのモデルへの進化などがある。全体として、効率的なトークン圧縮により、学習と推論にかかる時間が34%短縮されたという。

論文によると、インターネットから収集された学習素材は、少なくとも1Kの解像度を持つ3,300万枚の画像と、4Kの解像度を持つ230万枚の画像で構成されている。これは、PixArt-αのトレーニング素材の1400万画像の2倍以上である。しかし、SDXL 1.0で処理された1億枚の画像にはまだ遠く及ばない。

学習教材の画像の解像度に加え、説明文の精度も重要な役割を果たしている。PixArt-αでLLaVAを使用した場合、研究者たちは幻覚を観察したが、GPT-4Vベースのシェアキャプショナーによって、この問題はほとんど解消されたとのことだ。このオープンソースツールは、PixArt-Σモデルを学習するために収集された画像に対して、詳細かつ正確なキャプションを記述する。

さらに、トークンの長さを約300ワードに増やしたことで、テキストプロンプトと画像生成の間のコンテンツマッチングも向上しているとのことだ。

他のモデルと比較して、PixArt-Σは、6億という比較的少ないパラメータ数にもかかわらず、SDXL(26億)やSD Cascade(51億)といった既存のオープンソースのテキスト画像拡散モデルよりも、画質とプロンプトマッチングの点で優れた性能を示している。さらに、PixArt-αに匹敵する1Kモデルは、オリジナルのPixArt-αに必要なGPU学習時間のわずか9%で済んだという。

PixArt-Σは、Adobe Firefly 2、Google Imagen 2、OpenAI DALL-E 3、Midjourney v6といった市販のモデルにすら追いつくことができる、と研究者たちは主張している。

だが研究者たちは、サンプル画像にテキストコンテンツを表示していない。特にStable Diffusion 3、Midjourney、Ideogramは最近この分野で大きな進歩を遂げたが、PixArtは高解像度の写真に焦点を当てたトレーニングを行っているため、あまりうまくいかない可能性が高い。

「PixArt-Σで示されたイノベーションは、AIGCコミュニティの進歩に貢献するだけでなく、より効率的で高品質な生成モデルにアクセスするための道を開くと信じています」と科学者たちは論文で結論付けている。

学習データをより効率的に扱う方法に関する彼らの洞察は、他の研究にも役立つだろう。PixArt-αは最終的にオープンソースとしてリリースされたが、PixArt-Σがそうなるかどうかはまだわからない。

論文

参考文献

研究の要旨

本論文では、4K 解像度の画像を直接生成できる Diffusion Transformer model(DiT)である PixArt-Σ を紹介する。PixArt-Sigmaは、その前身であるPixArt-alphaから大きく進歩し、著しく忠実度の高い画像を提供し、テキストプロンプトとの整合を改善した。PixArt-alphaの主な特徴は、トレーニングの効率性である。PixArt-alphaの基礎となる事前学習を活用し、「弱い」ベースラインから、より質の高いデータを取り込むことで「強い」モデルへと進化させる。PixArt-Sigmaの進歩は2つある:(1) 高品質のトレーニングデータ:PixArt-Sigmaは、より正確で詳細な画像キャプションと組み合わされた、優れた品質の画像データを組み込んでいる。(2) 効率的なトークン圧縮:DiTフレームワークの中で、キーと値の両方を圧縮する新しいアテンションモジュールを提案し、効率を大幅に改善し、超高解像度の画像生成を容易にする。これらの改善により、PixArt-Sigmaは、SDXL(2.6Bパラメータ)やSD Cascade(5.1Bパラメータ)などの既存のテキストから画像への拡散モデルよりも大幅に小さいモデルサイズ(0.6Bパラメータ)で、優れた画質とユーザープロンプトの遵守能力を実現する。さらに、PixArt-Sigmaの4K画像生成機能は、高解像度のポスターや壁紙の作成をサポートし、映画やゲームなどの業界における高品質なビジュアルコンテンツの制作を効率的に強化する。

コメントを残す