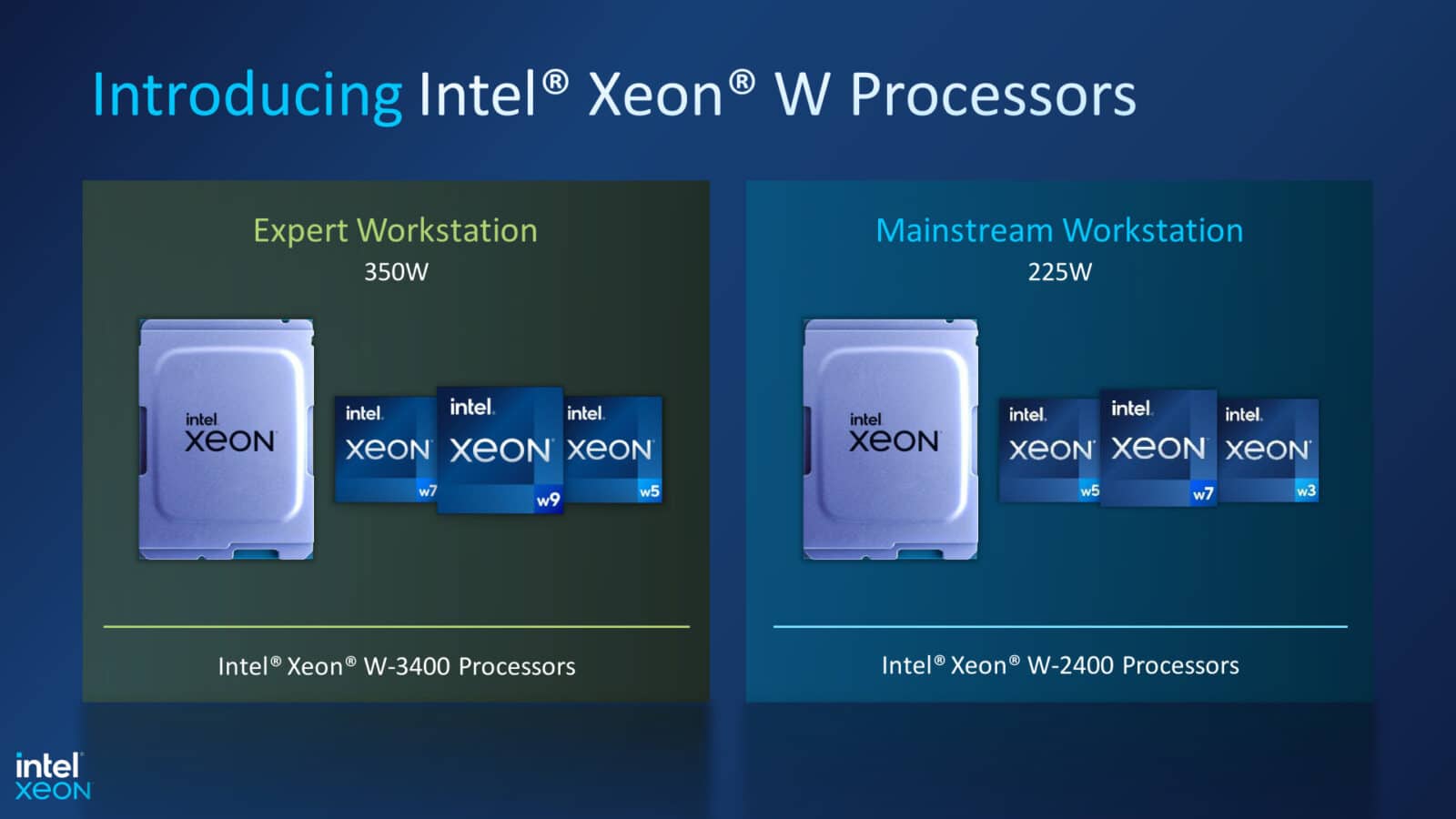

Intelは、新しいワークステーション用プロセッサ「Xeon W-3400」と「Xeon W-2400」シリーズを発表した。これらのチップは、特にCPUコアの増加、PCIeレーンの増加、メモリ帯域の増加、あるいはこれら3要素の組み合わせを必要とする高性能デスクトップ・ワークステーション用途に向けたラインナップとなっている。新しいXeon W SKUは、Intelが最近発表したサーバー用部品と同じSapphire Rapidsシリコンをベースに、Intelの最先端サーバーシリコンで取り入れられた機能の多く(全てではない)を搭載する。

目次

新しいXeon Scalableプロセッサと同様、Intel の Golden Cove CPU アーキテクチャへの移行(IPC とクロックスピードの向上)と、DDR5メモリとI/O接続用のPCIe 5のサポートが主な追加要素となっている。これらはすべて、Intelの以前の製品スタックを構成するCascade LakeとIce Lakeの混合パーツよりも大幅にアップグレードされたものだ。一方、Intelの既存のデスクトッププロセッサのラインナップと比較すると、これらはすべて2021年後半にAlder Lake(第12世代Core)で開拓された機能である。

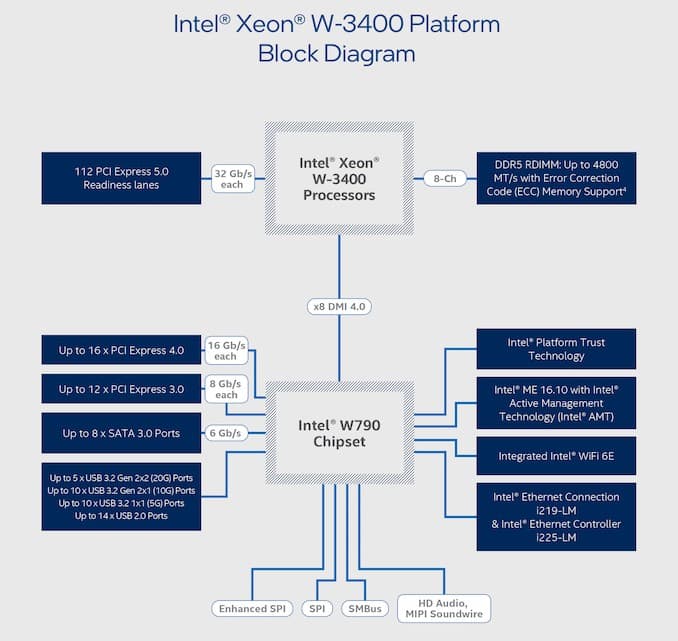

上位から順に、Xeon W-3400シリーズ(Sapphire Rapids-112L)は、12コアから56コアまでさまざまで、いずれもPCIe 5.0の112レーン、8メモリチャネルで最大4TBのDDR5-4800メモリのサポート、ECCメモリ(RDIMMのみ)、Intel vPro、ISM (Intel Standard Manageability)などが搭載される予定だ。W-3400の7つのSKUのうち4つ(Xシリーズ)は、アンロックされたマルチプライヤを備えており、オーバークロックを公式にサポートしている。一方、Xeon W-2400シリーズ(Sapphire Rapids-64L)は、6~24個のCPUコアと、64レーンのPCIe 5.0接続、4メモリチャネルで最大2TBのDDR5-4800メモリのサポート、ECCメモリなどXeon Wのすべての機能を備えている。

| 2021 | 2022 | 2023 | |

| エキスパートクラス | Xeon W 3300 (Ice Lake-64L) & Xeon W-3200 (Cascade Lake-64L) | Xeon W-3400 (Sapphire Rapids-112L) | |

| メインストリームクラス | Xeon W-2200 (Cascade Lake) | Xeon W-2400 (Sapphire Rapids-64L) | |

| エントリークラス | Xeon W-1200 (Rocket Lake-S) | 12th Gen Core (Alder Lake-S) + W680 Chipset | 13th Gen Core (Raptor Lake-S) + W680 Chipset |

新しいXeon Wは、Intelの異なるXeon世代を置き換えることになる。Intelは2021年にIce LakeベースのXeon(Xeon W-3300ファミリー)をいくつか発売したが、これらのパーツは、追加のCPUコアやPCIe帯域を必要とする特定の顧客向けの、IntelのXeonラインアップの補足的な更新のようなものだった。それ以外の人たちにとっては、2019年頃のW-3200ファミリーやW-2200ファミリーというXeon W製品スタックは、IntelのCascade Lakeシリコンをベースにしてきた出がらしのようなものだ。そのため、Intelのワークステーションラインナップに対するXeon W-3400/2400シリーズの投入の重要性は過言ではなく、IntelのXeonワークステーションスタックの大規模なオーバーホールとアップグレードとなる。

新しいXeon Wは、AMDのZen 3アーキテクチャを採用したAMDのThreadripper Pro 5000 WXに対抗することになる。最新のThreadripper Proパーツは昨年の春に発売されましたが、それ以来、コア数とIPCで大きなアドバンテージを持つAMDは、CPU性能の面で実質的に市場をリードしてきたのだ。しかし、IPC、コア数、クロックスピードが向上したことで、CPUの全体的な性能の面で、競争の場を均等にすることができるはずだ(ただし、どの程度均等にできるかは未知数だ)。

Intel Xeon W-3400シリーズ

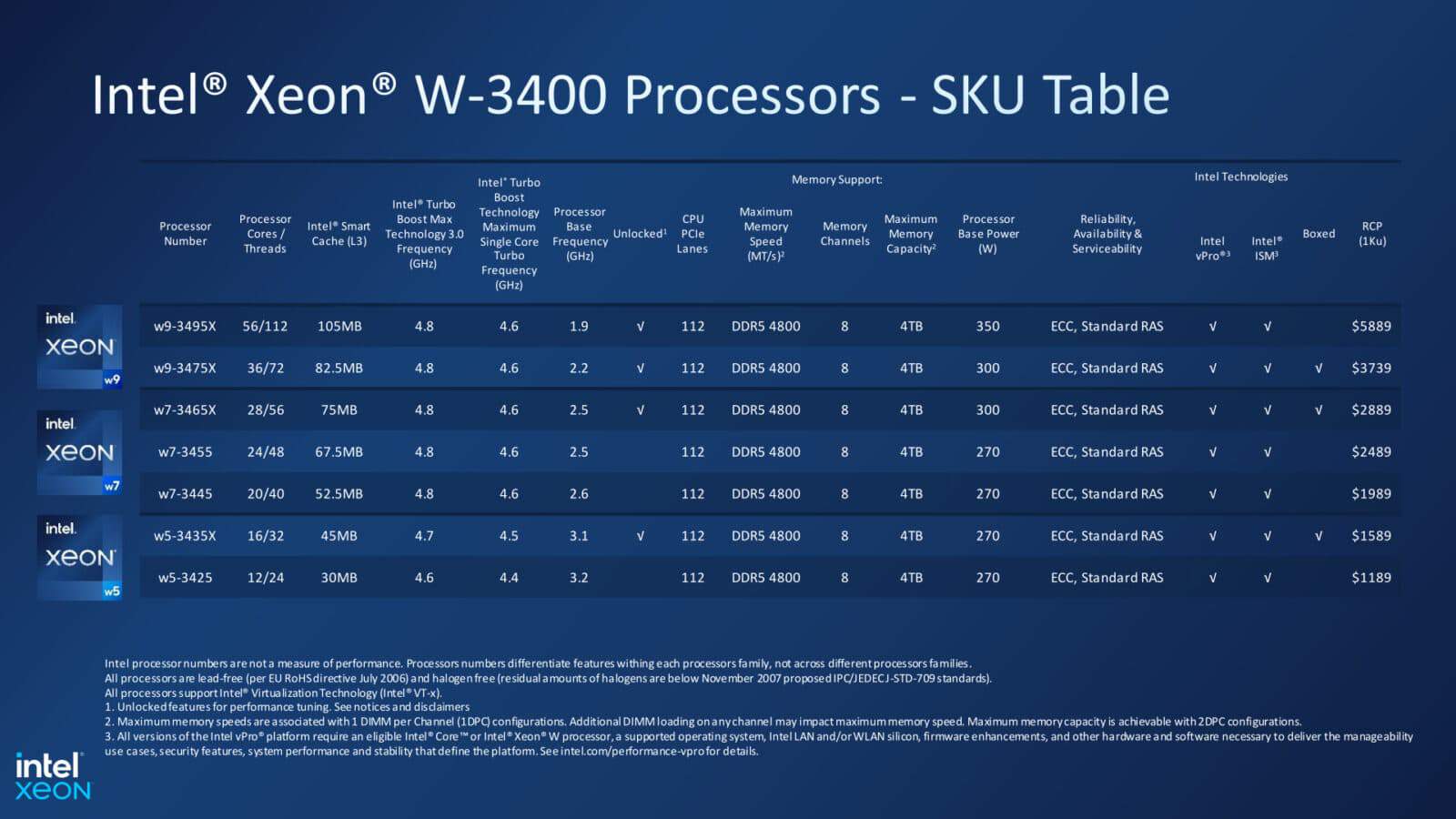

IntelのXeon W-3400シリーズとW-2400シリーズのワークステーション用プロセッサは、IntelのAlder Lake(第12世代)デスクトップ用プロセッサと同じアーキテクチャであるGolden Cove CPUアーキテクチャをベースにしている。W-3400シリーズは、Intelの第4世代XeonスケーラブルSapphire Rapidsプレミアム・ワークステーションの最高級ラインアップに相当し、合計7つのSKUを備えている。Xeon W-3400は、12コア/24スレッド(w5-3425)から、56コア/112スレッド(w9-3495X)のフラッグシップモデルまで、幅広いラインナップを取り揃えている。

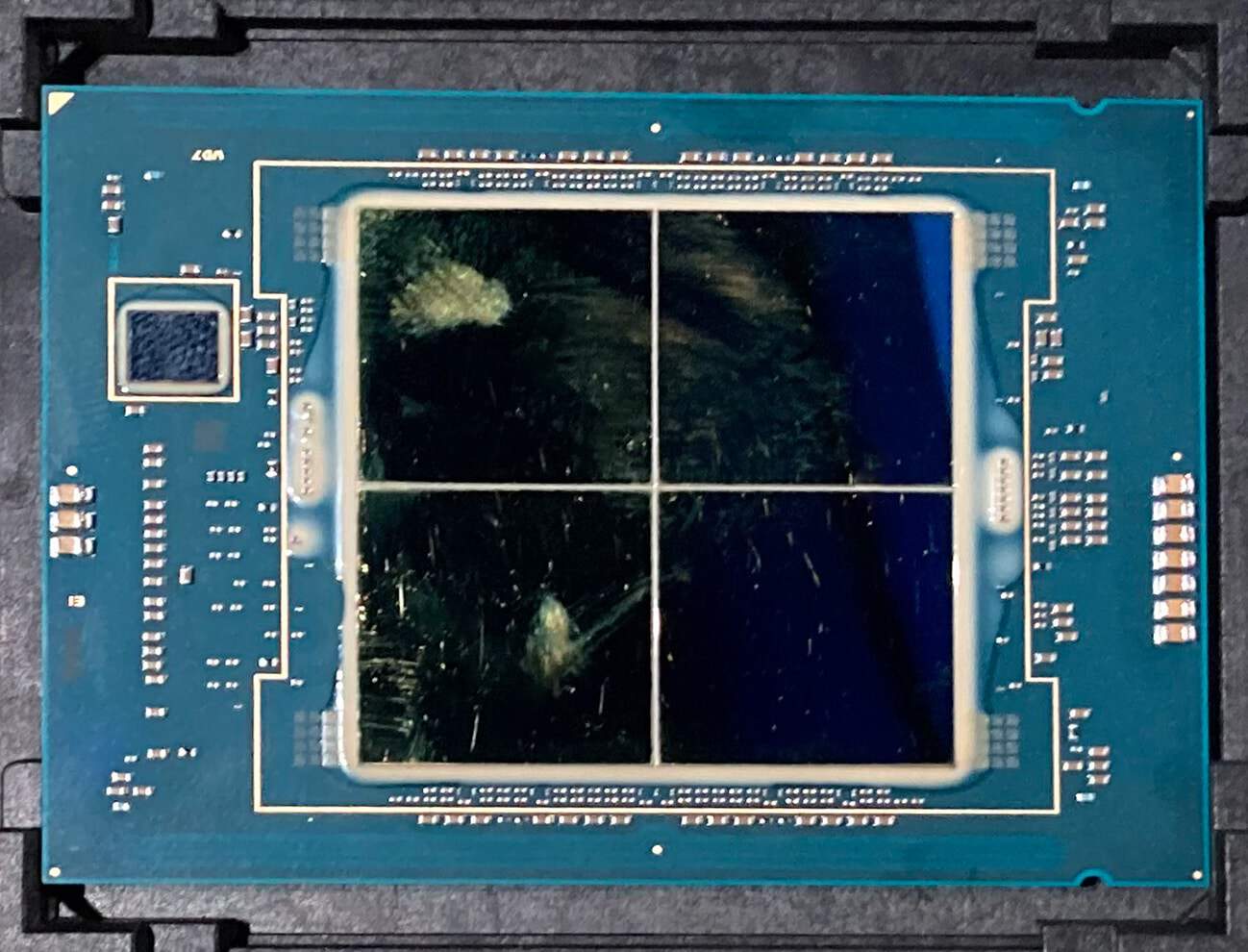

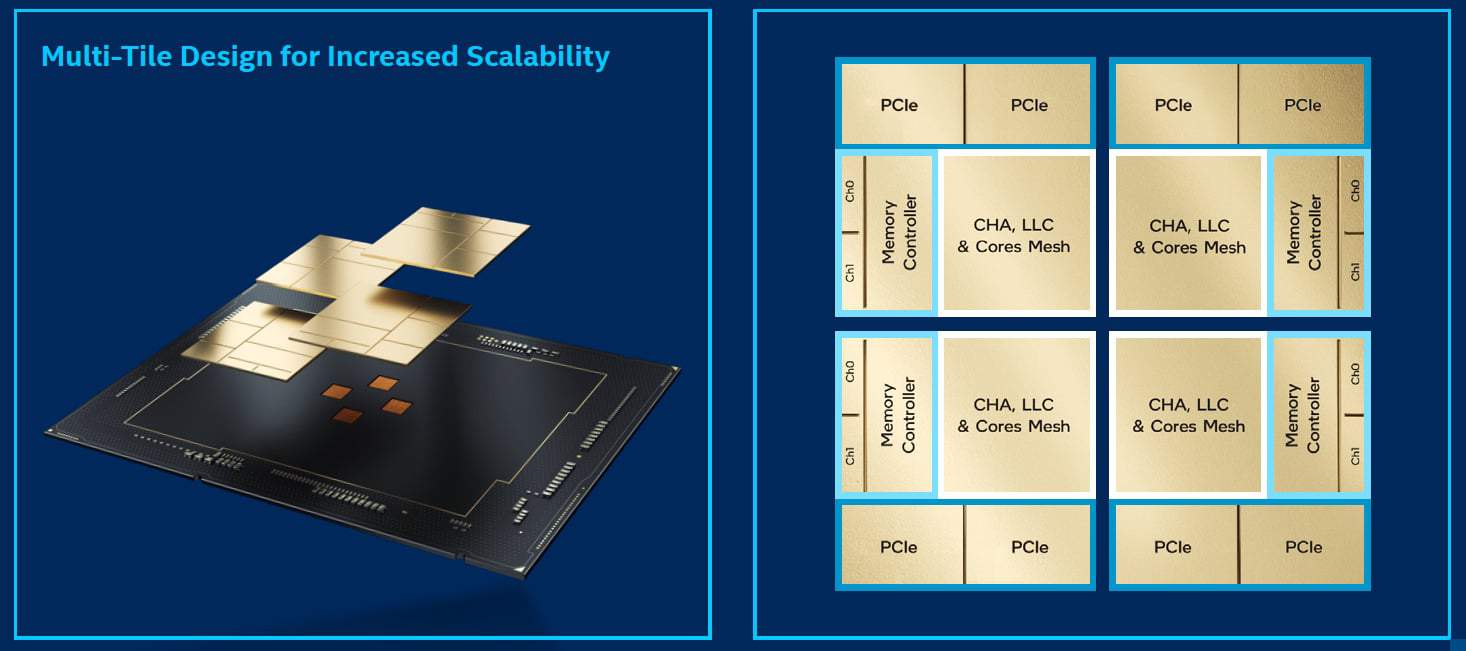

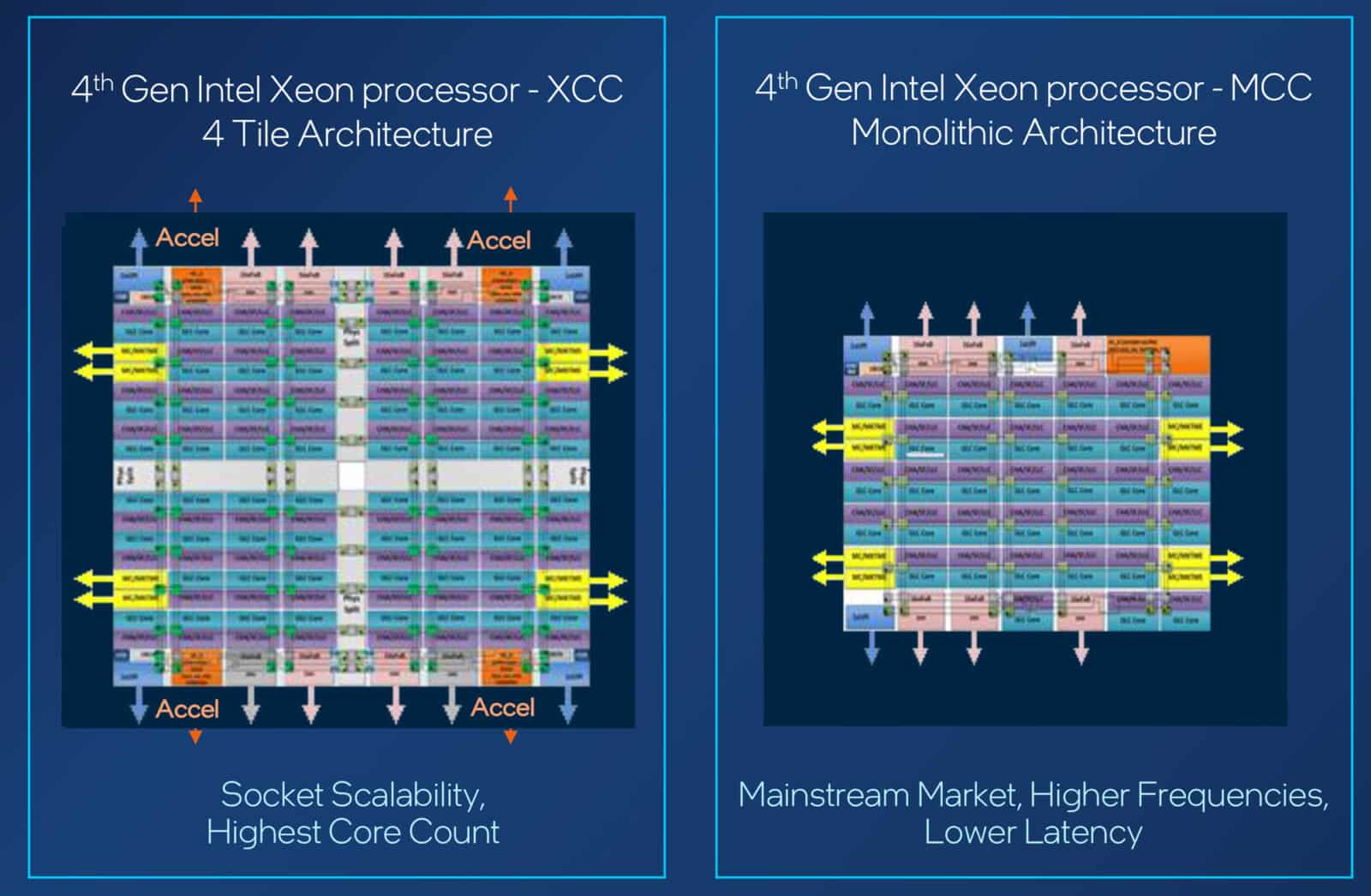

特にXeon W-3400シリーズでは、現在Intelの上位Xeonサーバー向け製品に採用されているSapphire Rapids Extreme Core Count(XCC)シリコンをベースにしている。XCCシリコンは、Intelの最新のEMIBインターコネクトを使用して結合された4つのコンピュートタイルを使用しており、Xeonワークステーションプロセッサとしては初の試みとなる。

Sapphire Rapids XCCチップの個々のタイルは、すべて同一/対称であるため、各タイルはチップ全体のCPUコア、I/O、メモリチャネルの4分の1を提供する。そのため、各タイルは最大 32 の PCIe 5.0 レーン(w9-3495X では合計 112)を提供でき、また各タイルには最大 2 つのメモリコントローラが含まれ、W-3400 シリーズ全体で 8 チャネルのメモリを提供する。

Xeon W-3400ファミリーの最上位SKUであるIntel Xeon w9-3495Xに焦点を当てると、2019年に発売されオーバークロックに正式対応したIntelの前Xeon W-3175Xに似た部分が見られる。SkylakeベースのXeon W-3175Xと同様に、最新のXeon w9-3495Xもオーバークロックのために倍率をアンロックしている。

Intel Xeon w9-3495Xは56コア(112スレッド分)を搭載しており、Intelのデスクトップ向けパーツとは異なり、最後の1つまでがパフォーマンス(P)コアになっている。また、合計105MBのIntel Smart L3 Cacheを搭載し、8チャネルのDDR5-4800 ECC RDIMMメモリを公式にサポートし、最大容量は4TBまでとなる。

w9-3495Xは、ベースとなったサーバーパーツと同様、TDPが350Wとかなり高めになっている。実際には、IntelのTurbo BoostおよびTurbo Boost Max 3.0テクノロジを有効にしたフルロード時、特に56アンロックコアでは、ピーク消費電力がかなり高くなる可能性がある。56個のGolden Coveコアのベース周波数は1.9GHzだが、ターボ周波数は最大4.6GHzで、Turbo Boost Max 3.0(Intelの優遇コア技術)により、一部のコアは4.8GHzまでさらにブーストできるようになっている。

Xeon W-3400ファミリーの他のSKUは、w9-3475X(36C/72T)やw5-3425(12C/24T)など、36コアから12コアまでの製品に及んでいる。 最終的に、すべてのXeon W-3400は同じ数のDDR5メモリチャネルとPCIeレーンを提供しており、CPUコア数、最大メモリクロック速度、L3キャッシュ、そしてもちろん価格によって各SKUが分けられている。

一方、前述の通り、Xeon W-3400のうちw9-3495X、w9-3475X、w7-3465X、w5-3435Xの4SKUは、いずれも「アンロック」プロセッサである。これは、Intelがここ数年、Xeon Wで提供していなかったもので、いくつかの興味深い影響がある。アンロックプロセッサーは、CPUのクロックスピード倍率を変更できるという最も基本的な機能のほか、AVXとAMXのオフセットも調整でき、SIMD負荷が高い場合でもプロセッサがそれほど落ちないようにすることが出来る。最後に、これらのパーツはすべて、メッシュインターコネクトのチューニングオプションも提供しているが、Intelはここで正確に何が調整できるかは明言していない。

Intel Xeon W-3400ファミリーの価格は1,189ドルからで、Intelは1KPUあたりの価格(トレイ)で価格を提示しており、個別に購入するリテールSKUの価格ではない。Xeon w9-3495Xの1KPU価格は5,889ドルで、トップSKUとそれ以降の各W-3400 SKUは、前世代のXeon W-3300チップよりも高価になっているが、より多くのコア数、より速いターボ周波数、より多くのL3キャッシュ、DDR5-4800のサポートが搭載されている。

IntelのW-3400は、最下位のw5-3425(12C/24T)でも、8チャネルDDR5-4800 ECCメモリで最大4TBをサポートするのが特徴だ。このように、Xeon製品群には、大量のDRAMを必要とするが、CPUコアの数は必ずしも多くないというシステムにも対応できるオプションが用意されている。ただし、実際に4TBを実現するには、チャネルあたり2つのDIMM を使用し、DDR5-4400メモリ速度に落とす必要があることに注意が必要だ。

CPUから112本のPCIe 5レーン(チップセットからはさらに多くのレーン)が利用できるため、Xeon W-3400チップはかなり膨大な数のI/Oデバイスをサポートすることが出来る。x16のグラフィックカードなら7枚、x4の高速ストレージなら最大28台という計算だ。これは、コア数やメモリチャネル数とともに、下位のXeon W-2400シリーズとの主要な差別化要因の1つであり、Intelの以前のXeon WパーツでI/O帯域幅のほんの一部に留まっていたIntelプラットフォームのユーザーにとっては歓迎すべき開発であるはずである。

興味深いことに、112本のPCIe 5レーンは、IntelがSapphire Rapidsサーバーパーツで提供しているよりも実際に多い。Xeon Scalableのラインアップは、最高でも80レーンに過ぎない。 この差は、Intelがサーバー向け製品で7つのルートポートのうち5つしか有効にしておらず、さらに2ポート(32レーン)が未使用のままになっていることに起因している。しかし、ワークステーションのSapphire Rapidsは、IntelのマルチソケットUPIリンクのサポートにピンを割り当てる必要がないため、Intelはその代わりに、ワークステーション向けの追加PCIeレーンを搭載するためにピンを割り当てたようだ。Intelは、サーバーとワークステーションのチップに同じソケット(LGA 4677)を使用していますが、ピンが変更されているため、互換性がある訳ではないようだ。

一方、Intelにとってもう1つの初めての試みとして、同社はRDIMMのDDR5 XMP 3.0メモリ・オーバークロック・プロファイルをサポートする予定であることを発表した。この発表に関する詳細は非常に少ないが、高いレベルで、W790で動作するアンロックプロセッサの所有者に、可能であればメモリからより多くを絞り出そうとする選択肢を与えることになる。一般に、メモリのオーバークロックとRDIMMの揺るぎない安定性は、正反対の目標なので、これが市場でどう展開されるかは興味深いところです。DRAMはDDR5-4800だけでなく、より高いクロックが出せるかもしれないが、RCD(Registered Clock Driver)はどうなるかは不明だ。

こうしたRDIMMを明示した話はすべて意図的なもので、これまでのXeon Wプラットフォームからの大きな変化として、Sapphire Rapids XeonワークステーションプラットフォームはUDIMMをサポートしないことになっている。これは DDR5 仕様の制限で、UDIMM と RDIMM でそれぞれ異なる電圧を要求している。UDIMMが5ボルトであるのに対し、RDIMMは12ボルトであるため、両者に互換性がないのです。DDR5 RDIMM を実際に見たことがある方は、UDIMM とはキーイングまで異なることにお気づきかも知れないが、このように物理的にも電気的にも互換性がない。

結局のところ、ユーザーはこれらのプロセッサーと W790 マザーボードを、より高価ではあるが高品質のECC対応DDR5 RDIMMと組み合わせなければならないことになる。しかし、HEDTスタイルのシステムやローエンドワークステーションを安価に構築したいと考えている人にとっては、Xeon Wシステムの最終価格が、W-3200/2200シリーズで実現できる価格よりも高くなる事に気がつかれることと思う。

アクセラレイティッド・コンピューティング

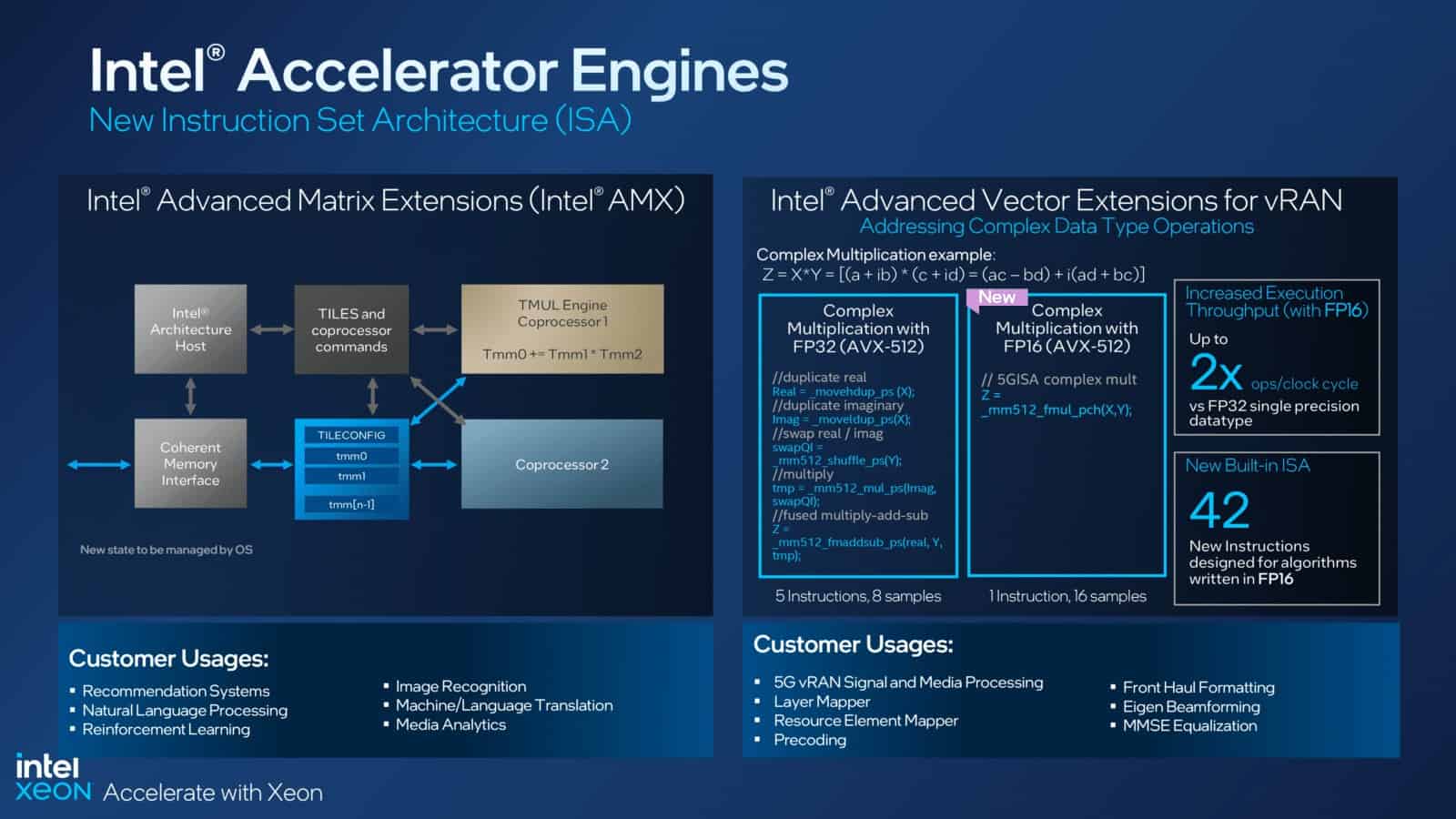

Intelは、Sapphire Rapids Xeonシリコンとそのサーバーパーツにおいて、さまざまなアクセラレーションブロックとその他のアクセラレータ関連機能を導入した。マトリックス拡張(AMX)、様々なドメイン固有のハードウェアアクセラレーションブロック、そして外部アクセラレータのためのCompute eXpress Link(CXL)のサポートにより、IntelはCPU以外のタスクにかなりの量のシリコンを割くことになった。そのため、特にXeon Scalableサーバーパーツでは、Intelはこれらのアクセラレータ機能に寄りかかることを選択し(必要なければ)、すべてのチップで1つのDSAエンジンが有効になっていることを意味している。ただし、QAT、DLB、IAAはサポートされていない。これは、ハードウェアを先行製品や競合製品と差別化するために、単に生のx86 CPUの性能の代わりとしている。

しかし、彼らのワークステーション向けパーツについては、良くも悪くももう少しわかりやすい。つまり、Xeon W-3400/2400ファミリでは、Intelのアクセラレーション・コンピューティング機能のすべてが利用できるわけではないのである。

おそらく最も重要なのは、IntelのAdvanced Matrix Extensions(AMX)が採用され、Xeon W-3400/2400ファミリーではそのサポートが完全に有効化されていることだろう。AMXはIntelの行列演算実行ブロックであり、テンソルコアなどの行列アクセラレータと同様に、行列演算を効率的に実行するための超高密度なブロックである。AMXは専用のアクセラレータではなく、CPUコアの一部であり、各コアにブロックが用意されているため、AMXのコードとx86(およびAVX)のコードを混ぜることができ、Sapphire Rapidsが超高密度コードを使用するために負のクロックスピードオフセットを持つ理由もそこにある。

AMXは、Intelがディープラーニング市場に投入するもので、AVX-512で現在達成できるスループットを、さらに高密度なデータ構造を用いることで超えていく。Intelには、これをも超えるAMX対応GPU(Intel Data Center Max GPUシリーズ)があるが、Sapphire Rapidsでは、柔軟性の低い専用アクセラレータではなく、CPUコアのごく近くでAI推論を行う必要がある顧客層への対応を考えているのだろう。新しいAMXユニットはBfloat16もサポートしており、Intelの加速コンピューティングブロック(AVXとAMX)のすべての階層で、この深層学習用の共通中間精度浮動小数点形式をサポートできるようにしている。

Sapphire Rapidsの新しいドメイン特化型ハードウェアアクセラレータブロックの1つ、Data Streaming Accelerator(DSA)も採用された。このブロックは、データコピーやCRC32の計算などの単純な計算など、特定の処理をオフロード/アクセラレートするためのものだ。DSAブロックは、Xeon WのすべてのSKUで利用可能だ。

しかし、Intel Dynamic Load Balancer(DLB)、Intel In-Memory Analytics Accelerator(IAA)、Intel QuickAssist Technology(QAT)など、Intelの他のアクセラレータブロックについての言及は見当たらない。これらのアクセラレータは、Sapphire Rapidsのシリコン上ではすべて同じ機能ブロックの一部であるにもかかわらず、である。これらの他のアクセラレータブロックは、いずれもサーバーを主なターゲットとしているため、含まれていないのは驚くことではないが、サーバー向けのコードを試作する人は、これらの機能を使用する場合、実際のXeon Scalableでテストする必要があることを意味する。

最後に、IntelのXeon WのスペックシートにはCXLのサポートが記載されていないが、Intelは、両ファミリーで実際にサポートされていることを確認している。ホストからデバイスへの接続のためのビルトオンオンPCIe規格は、数年前から準備されており、Sapphire Rapidsは、この技術をサポートする最初のIntel CPUプラットフォームとなる。他の機能と同様、この技術は主にサーバー向けであるため、ワークステーションに導入する必要性はあまりない。しかし、Intelは、その機能を活用したいユーザーのために、これを可能にしたのである。

Intel Xeon W-2400シリーズ

1ランク下のXeon W-2400シリーズ(Sapphire Rapids-64L)は、「メインストリーム」のワークステーションプラットフォームとして設計されている。Xeon W-2400は、PCIeレーンがW-3400 SKUの半分強の64レーン、メモリチャネル数も半分の4チャネルが利用可能だ。そのため、W-2400シリーズでは、エントリーモデルのXeon w3-2423が359ドルと、W-3400シリーズよりも低価格になっている。

Xeon W-2400シリーズ全体では、6コアから最大24コアまでとなる。Intelは、Sapphire RapidsのMCC(Medium Core Count)シリコンを使用しており、XCCシリコンとは異なり、従来のモノリシックダイである。このため、チップの製造には、派手なEMIBパッケージは必要なく、Intelは1つの大きなダイを製造するだけでよい。

Xeon W-2400の最上位はw7-2495Xで、24コア/48スレッド、45MBのIntel Smart L3キャッシュ、TDP 225ワットとなっている。 また、Intelは、3つのw5シリーズSKU、そして最後にw3 SKUのトリオを用意している。

Xeon W-2400シリーズは、エキスパートクラスと同様に、メモリとI/Oの構成が全ラインナップで一貫している。CPUから64レーンのPCIe 5、4チャネルのDDR5メモリを搭載し、全体で最大2TBのメモリを搭載することができる。また、w5とw7のSKUだけがDDR-4800のフルメモリ速度を提供し、w3のパーツはすべてDDR4-4400に制限されていることも指摘しておく価値がある。ただし、すべてのSKUは、2DPC構成でこの速度に落ちるので、何らかの理由で2TBシステムを構築しようとしていたとしても、ペナルティを受けることはないだろう。

Xeon W-3400シリーズと同様に、W-2400ファミリーにも、最上位のw7-2495Xを含む、アンロックされたX SKUがいくつか用意されている。その他、20コア、37.5MBのL3キャッシュを搭載したw7-2475Xや、2つのw5 SKU(w5-2465X 16C/32Tとw5-2455X 12C/24T)がアンロックされた倍率のSKUである。しかし、3つのエントリーレベルのw3 SKUはすべて完全にロックダウンされているため、アンロックされたw3パーツは見当たらない。

Intel W790チップセット:Xeon W-3400とW-2400の両プラットフォームをサポート

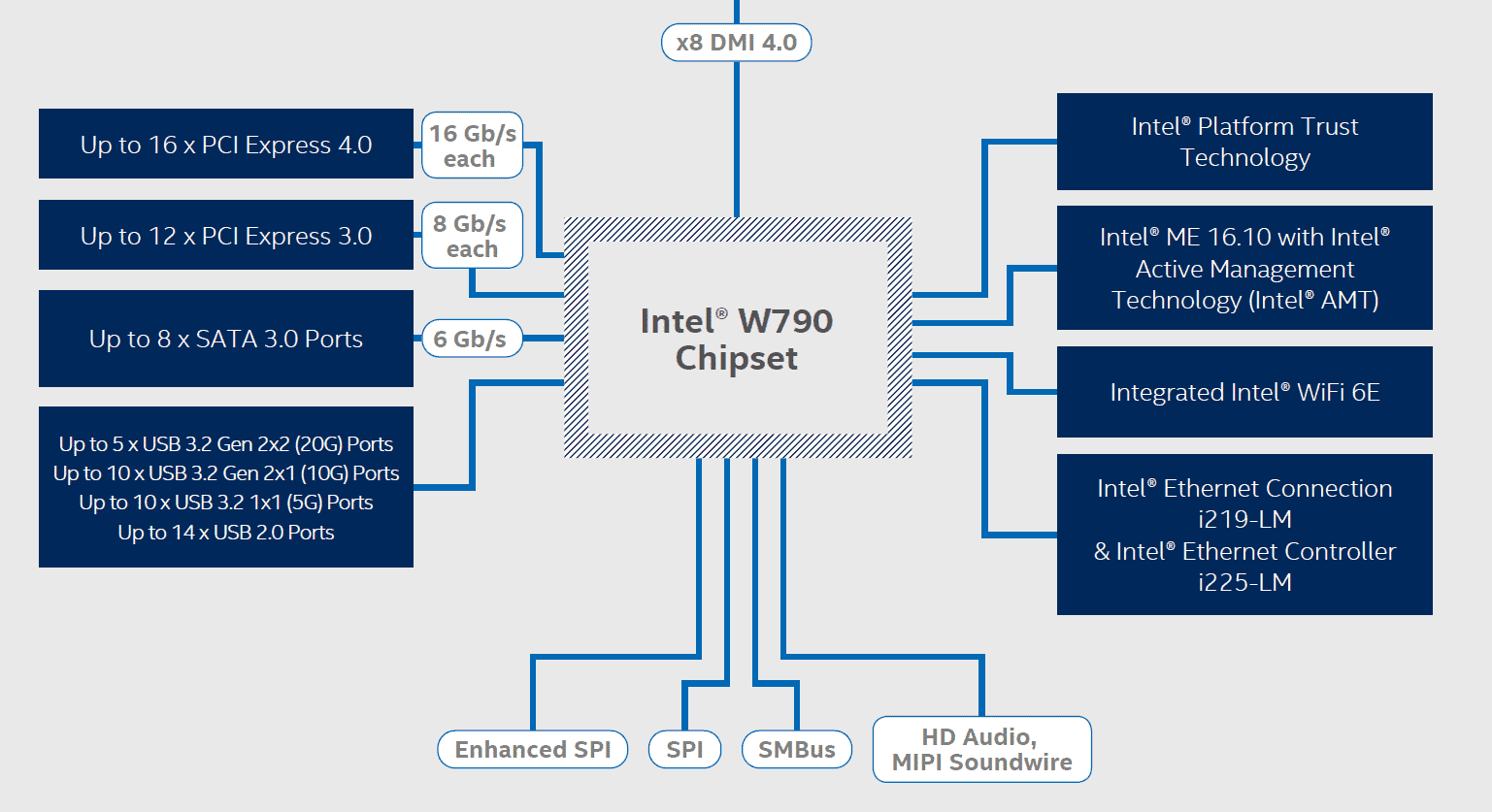

IntelのXeon W-3400とW-2400シリーズは、Intel vProとIntel Standard Manageability (ISM)の技術を利用している。Xeon W-2400およびW-3400ファミリーは、関連するW790チップセットによってサポートされているが、メモリチャネルやPCIeレーンの数など、CPU固有の機能はプロセッサに依存する。

W790チップセットの主な特徴としては、プロセッサとチップセット本体の間にDMI(Direct Media Interface)4.0 x8リンクを搭載するほか、最大16本のPCIe 4.0レーン、最大8本のSATA 3.0ポートをサポートすることなどが挙げられる。W790は、最大5つのUSB 3.2 Gen2x2(20Gbps)ポートをサポートし、Intel Wi-Fi 6E PHYを搭載し、2.5GbEコントローラをネイティブでサポートすることが出来る。

新しいマザーボードについての言及はないが、ASUS、GIGABYTE、Supermicro、ASRockといったベンダーからIntel W790マザーボードが発売されると予想される。Dell、Lenovo、Supermicroなどのシステムインテグレータが、DIYビルダーが手にする前に、まず優先的にソリューションやシステムを提供することが予想される。

最新世代のマザーボードに関して特筆すべきは、Xeon W-3300シリーズ(Ice Lake)に対応したC621Aベースのボードに比べて、W790のボードはコストが高くなる可能性が高いということだ。これは、W790のボードはDDR5メモリが4レーン、PCIe 5が48レーン多く計上されているためだ。いずれ、スロットやI/O構成の異なるレベルのボードデザインが登場すると思われるが、これらのマザーボードの一部が両ファミリーに対応するのか、あるいはベンダーが個々のXeon W-3400シリーズとW-2400シリーズを中心に特定のボードを設計するのか、Intelは明示していない。

IntelのXeon W-3400およびW-2400プロセッサは、業界のパートナーから予約注文を受け付けており、システムの導入は3月上旬に予定されている。Intelは、Xeon w3-2423の359ドルからXeon w9-3495Xの5889ドルまでの価格を予定しており、推奨価格も設定している。

Source

コメントを残す