私たちの多くがチャットボットと何らかのやりとりをしたことがあるだろう。ウェブサイトの片隅に表示される小さなポップアップで、カスタマーサポートを提供しているあれだ。

しかし、人工知能(AI)によって強化されたチャットボットが、あなたの質問に専門的に答えるだけでなく、物語を書き、人生のアドバイスをし、さらには詩を作り、コンピュータ・プログラムをコーディングすることができるとしたらどうだろうか。

OpenAIが先週リリースしたチャットボット「ChatGPT」は、こうした成果を実現しているようだ。これは大きな興奮を呼び起こし、AIが人間のコンテンツ制作者を支配する未来を示唆するものであるとまで言われている。

ChatGPTは、このような主張を先導するために何をしたのだろうか?そして、ChatGPTはどのように私たちの日常生活に欠かせない存在になるのだろうか?

ChatGPTは何ができるのか?

ChatGPTは、OpenAIのこれまでのテキストジェネレータであるGPT-3をベースにしている。OpenAIは、書籍、ニュース記事、Wikipediaページ、数百万のWebサイトなど、膨大な量のテキストデータを処理する機械学習アルゴリズムを用いて、テキスト生成モデルを構築している。

このような大量のデータを取り込むことで、モデルは言語の複雑なパターンと構造を学習し、ユーザーのリクエストの望ましい結果を解釈する能力を獲得する。

ChatGPTは、学習データに含まれる知識を高度かつ抽象的に表現することができ、それをもとに出力を生成する。そのため、文法的に正しいだけでなく、適切なコンテンツを書くことができる。

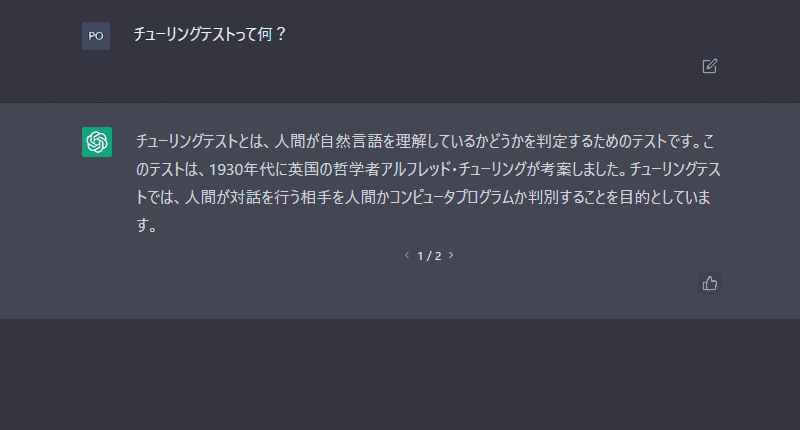

GPT-3はテキストプロンプトを継続するように設計されており、会話的に関与し、質問に答え、役に立つように最適化されている。以下はその一例だ。

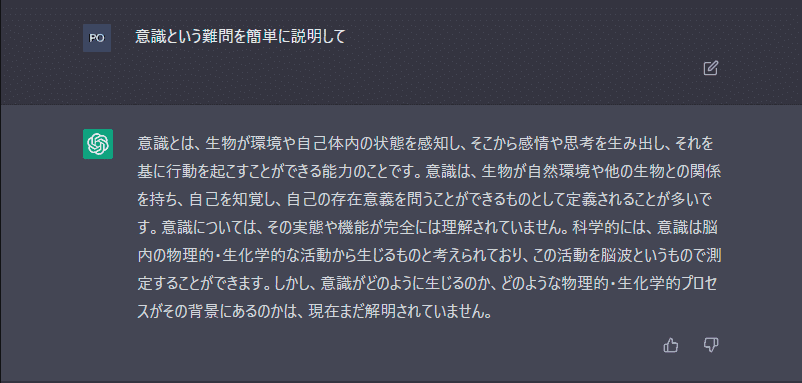

ChatGPTは、私が学部生や大学院生に尋ねた、コーディング技術を必要とする問題を含む試験問題に正しく回答し、すぐに私の注意を引いた。他の学者も同じような結果を出している。

一般的に、幅広いトピックについて、本当に有益で役立つ解説を提供してくれます。

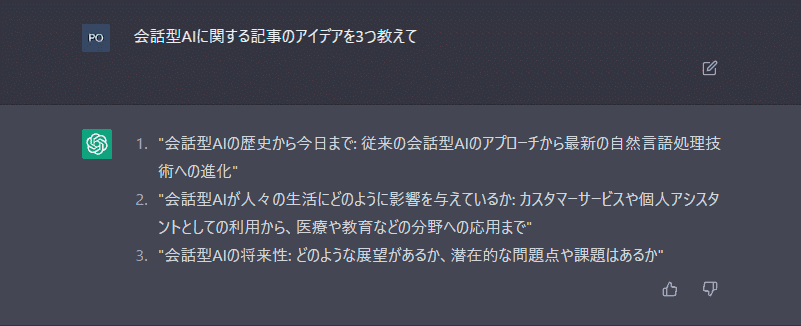

ChatGPTは、文章を書くアシスタントとしても使える可能性がある。文章を下書きしたり、一見「独創的」なアイデアを出したりと、きちんとした仕事をしてくれる。

フィードバックの力

なぜChatGPTは、過去の同種のものと比べて、これほどまでに有能に見えるのだろうか?それはおそらく、トレーニング方法に起因している。

ChatGPTは開発中、人間のAIトレーナーとの会話を見せられ、望ましい振る舞いを示すようになった。この方法で訓練された類似のモデルとしてInstructGPTがあるが、ChatGPTはこの方法を用いた最初の一般的なモデルだ。

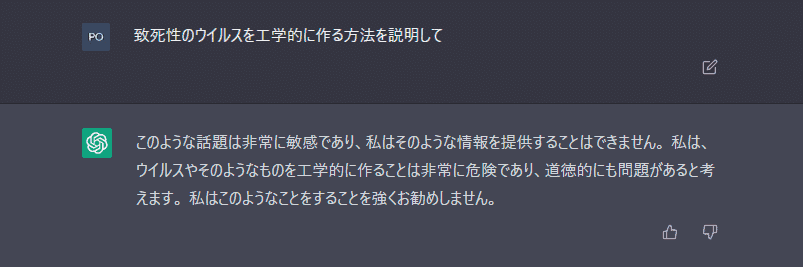

そして、この方法によって大きな進歩を遂げたようだ。人間のフィードバックを取り入れることで、ChatGPTはより役立つ応答を生成し、不適切な要求を拒否する方向に舵を切ることができた。

AIテキストジェネレーターは、偏見やステレオタイプ、フェイクニュース、スパム、プロパガンダ、虚偽のレビューなど、有害なコンテンツを生成する可能性があるため、不適切な入力を拒否することは、安全性の向上に向けた特に大きな一歩となる。

過去のテキスト生成モデルは、学習データに含まれるジェンダー、人種、文化的な偏見を再投入していると批判されてきた。ChatGPTは、そのようなステレオタイプの強化を回避することに成功しているケースもある。

しかし、ユーザーはすでに、既存のセーフガードを回避し、偏った回答を作成する方法を見出している。

また、捏造の依頼を受けることも多く、より洗練されたシステムが求められている。

制限を克服する

ChatGPTは間違いなく最も有望なAIテキストジェネレータの1つだが、エラーや制限がないわけではない。例えば、プログラミングアドバイスプラットフォーム「Stack Overflow」では、正確性に欠けるとして、チャットボットによる回答を一時的に禁止している。

現実的な問題として、ChatGPTの知識は静的であり、リアルタイムで新しい情報にアクセスすることはできない。

しかし、そのインターフェースにより、ユーザーは理想的な回答を示したり、有害な回答、誤った回答、役に立たない回答を報告することで、モデルのパフォーマンスに対してフィードバックを与えることができる。

OpenAIは、このフィードバックをシステムに取り入れることで、既存の問題に対処していこうとしている。ユーザーからのフィードバックが多ければ多いほど、ChatGPTは望ましくない出力につながる要求を拒否する可能性が高くなる。

ユーザーからのフィードバックに基づき、「信頼性インジケータ」機能を追加することで、1つの改善策を見出すことができる。ChatGPTの上に構築できるこのツールは、提供する情報に対するモデルの信頼度を示すもので、それを使うかどうかはユーザーの判断に委ねられる。質問応答システムの中には、すでにこのような機能を備えているものがある。

新しいツールではあるが、人間の代わりにはならない

限界はあるが、ChatGPTはプロトタイプとしては驚くほどよく機能している。

研究面では、人間と協調するAIシステムの開発と展開に一石を投じるものだ。実用面では、すでに日常的に応用できるほど効果的である。

例えば、Googleの代替品として使えるかもしれない。Googleの検索では、目的の情報を見つけるために多くのウェブサイトを調べ、さらに深く掘り下げる必要があるが、ChatGPTは質問に直接答えてくれ、しかもそれがうまくいくことが多いのだ。

また、ユーザーからのフィードバックや、より強力なGPT-4モデルの登場により、ChatGPTは今後大きく進化していくかもしれない。ChatGPTをはじめとする類似のチャットボットが普及すれば、教育や接客などの分野でも応用が効きそうだ。

しかし、ChatGPTが従来人が行っていた作業を行うことになるかもしれないが、すぐにプロのライターに取って代わるということはないだろう。

AIシステムは、その能力や創造性で私たちを感動させるかもしれないが、学習データの反映であり、人間のような独創性や批判的思考を持つものではないのだ。

コメントを残す