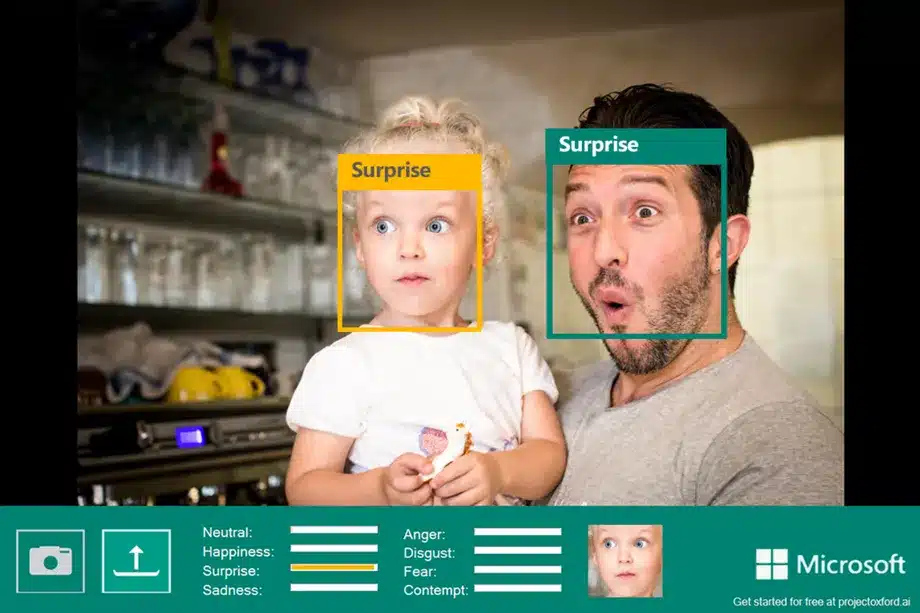

The New York Timesによると、Microsoftは、画像中の顔を分析する人工知能サービス「Azure Face API」から、物議を醸した、人の年齢、性別、感情の状態を予測する自動ツールを削除する予定とのことだ。

The New York Times : Microsoft Plans to Eliminate Face Analysis Tools in Push for ‘Responsible A.I.’

表情が感情を必ずしも反映しているわけではない

同紙によると、Microsoftは、偏見や信頼性が低い可能性があると批判されてきたこのAI機能を、今週から新規ユーザーには提供せず、既存ユーザーには年内に段階的に廃止するとしている。

Microsoftはまた、2年間のレビューの後、同社のAIシステムの要件とより厳しい制御を指示するMicrosoftが作成した文書、新しい「責任あるAI基準」を遵守するため、顔認識ツールの使用を制限する予定だという。The New York Timesによると、これらの要件は、MicrosoftのAIシステムが“解決するために設計された問題に対する有効なソリューション”と “疎外されたグループを含む特定人口集団に対する同質のサービス”を提供できるようにし、社会に有害な影響を与えることを防ぐために策定されたものだという。

MicrosoftのAI最高責任者であるNatasha Crampton氏が率いるチームは、人が雇用、教育、医療、金融サービス、または「人生の機会」へのアクセスについて決定を下すために使用できる新しい技術を、発売前に審査するとThe New York Timesは報じている。一部の企業は、人の感情状態を評価できるとするAIツールの販売を始めており、プライバシー擁護派の間で警鐘が鳴らされている。

こうした「感情認識」ツールには、専門家から批判が寄せられている。普遍的と考えられている顔の表情は集団によって異なるだけでなく、外見上の感情表現と内面的な感情を同一視することは非科学的であるというのが彼らの主張だ。

「AIシステムが社会の偏見や不公平を悪化させる可能性は、これらのシステムに関連する最も広く認識されている害の1つである」と、Crampton氏は火曜日のブログ投稿で述べている。「社内外の専門家は、『感情』の定義に関する科学的コンセンサスの欠如、ユースケース、地域、人口統計にまたがる推論の一般化方法における課題、この種の機能に関するプライバシー懸念の高まりなどを強調しています。」

MicrosoftのAzure AI担当プリンシパルグループプロダクトマネージャー、Sarah Bird氏は、ブログ投稿で、感情認識などのツールは、「制御されたアクセシビリティのシナリオのセットに使用すると、価値がある 」と述べている。ただ、これらのツールが他のMicrosoft製品で使用されるかどうかは不明とのことだ。

コメントを残す