Google Quantum AIのエンジニアリング担当副社長Hartmut Neven氏と量子ハードウェア担当ディレクターJulian Kelly氏は、第3世代の量子プロセッサScamoreを用いて、量子コードを大きくすることで計算のエラー率を下げ、1万分の1~1千分の1の範囲で制御できるようになったことを明かし、量子誤り訂正における重要なマイルストーンしたと発表した。

「0」と「1」を最小の演算ビットとする従来のコンピューターコンピューティングに対し、量子コンピューティングは量子力学に基づいて、飛躍的な計算能力を実現するものだ。

しかし、実際に複雑な量子ビット状態を使いこなすことは容易ではない。量子ビットは、その量子状態を完全に回復不能に失うことなく読み出すことができないため、その情報を単に冗長な量子ビットにコピーすることはできない。だが、量子コンピュータは今後、より大規模に利用されることが予想され、計算の正しさを保証することは、現在の量子コンピュータの開発者の多くが抱える重要な課題である。

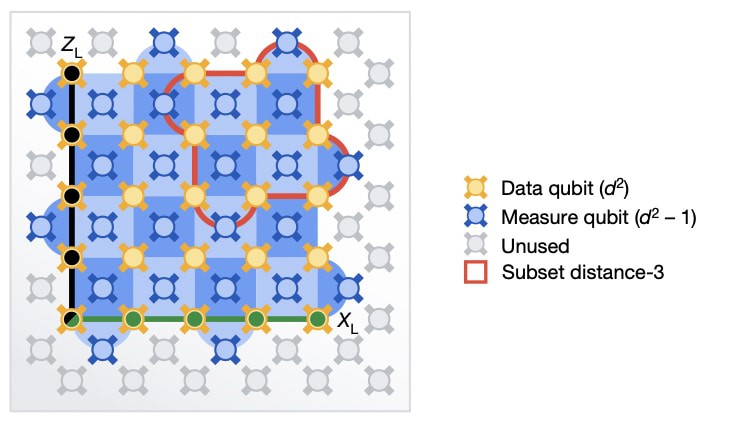

研究者らはこの問題に対処するため、精巧な「量子エラー訂正」方式を開発した。この方式では、誤り訂正付き論理量子ビットを作成することが一般的である。これは、量子ビットの集合の中に量子状態を分散させるというものだ。(計算論理的には、これらの量子ビットは1つの単位として扱われるため、「論理量子ビット」と呼ばれる。)エラー訂正は、論理量子ビットの各メンバーに隣接する追加の量子ビットによって可能になる。これらの量子ビットを測定することで、論理量子ビットの一部である各量子ビットの状態を推測することができる。

論理的量子ビットの一部であるハードウェア量子ビットの1つにエラーがあっても、論理的量子ビットの情報のほんの一部しか持っていないため、量子状態は破壊されないことになる。そして、その隣のビットを測定することでエラーが明らかになり、ちょっとした量子操作でエラーを修正することができる。

理論的には、論理量子ビットに割くハードウェア量子ビットの数が多ければ多いほど、堅牢性が高まるはずだ。ただ、現在、2つの問題がある。1つは、ハードウェア量子ビットに余裕がないことだ。最も高い量子ビット数を持つプロセッサーで堅牢なエラー訂正スキームを実行すると、計算に使う量子ビットは10ビット未満になってしまう。2つ目の問題は、ハードウェア量子ビットのエラーレートが高すぎて、どれもうまくいかないことだ。論理的な量子ビットに既存の量子ビットを追加しても、より堅牢になるわけではなく、一度に多くのエラーが発生し、修正できなくなる可能性が高くなるのだ。

この問題に対処するため、Googleの研究者たちは、量子エラー修正手順の2つのバージョンを実行した。1つは17個の量子ビットを使用したもので、一度に1つのエラーから回復することができた。より大きなバージョンでは、49量子ビットを使用し、2つの同時エラーから回復することができ、小さなバージョンが達成できたよりもわずかに良いパフォーマンスで、回復することが出来たという。

全体として、大きい方の論理的量子ビットのエラー率は2.914パーセントで、小さい方のエラー率は3.028パーセントだった。これは大した利点ではありませんが、この種の利点が実証されたのは初めてのことだ。ただし、どちらのエラー率も、この論理的な量子ビットの1つを複雑な計算で使うには高すぎることには変わりない。Googleは、大規模な論理的量子ビットに明確な利点をもたらすには、ハードウェア量子ビットの性能をさらに20%以上向上させる必要があると見積もっている。

「現在のところ、改善は非常に小さく、さらに大きなコードを使用すればさらに良い性能が得られるという保証はまだありません」とオランダのデルフト工科大学で量子誤り訂正を専門とする理論物理学者である Barbara Terhalは、今回の発見について説明する。

これは大きな前進だが、量子コンピューターが通常のスーパーコンピューターに取って代わるようになるには、まだ長い道のりが待っている。Google社でさえ、極低温技術の改善から量子ビットの材料に至るまで、さらに多くのことを行う必要があることを認めている。同社は、理想的な量子コンピューティングモデルにはまだほど遠く、これまでの開発設計図通りに量子コンピューティングの分野でより完全なアプリケーションを開発するには、少なくとも2030年までかかるとしている。

論文

参考文献

- Google: Our progress toward quantum error correction

- Nature: Google’s quantum computer hits key milestone by reducing errors

研究の要旨

実用的な量子コンピューティングでは、物理的な量子ビットで達成可能なエラーレートを大きく下回ることが要求されます。量子誤り訂正法 は、論理的な量子ビットを多くの物理的な量子ビットに符号化することで、アルゴリズム的に適切な誤り率を実現する方法を提供する。しかし、より多くの量子ビットを導入すると、エラー源の数も増えるため、コードサイズを大きくして論理性能を向上させるには、エラーの密度を十分に低くする必要がある。ここでは、いくつかのコードサイズにおける論理的な量子ビットの性能のスケーリングの測定結果を報告し、超伝導量子ビットのシステムが量子ビット数の増加による追加誤差を克服するのに十分な性能を持っていることを実証する。私たちの距離5の表面コード論理量子ビットは、25サイクルにわたる論理エラー確率とサイクルあたりの論理エラー((3.028 ± 0.023) %に対し、(2.914 ± 0.016) %)の両方で、距離3の論理量子ビットのアンサンブルよりも平均的に若干性能が良いことが分かった。この実験では、1つの高エネルギー事象によって1.7×10−6(この事象を除くと1.6×10 -7)の論理誤差が観測され、低確率で有害なエラー源を調査するために、距離25繰り返し符号を実行しました。この実験結果を正確にモデル化し、将来のシステムにおける最大の課題を浮き彫りにするエラーバジェットを抽出することができた。この結果は、量子誤り訂正が量子ビット数の増加とともに性能を向上させることを実験的に示すものであり、計算に必要な論理誤り率を達成するための道筋を明らかにするものである。

コメントを残す