写真の偽造は今に始まったことではない。1910年代、イギリスの作家Arthur Conan Doyleが、小学生の姉妹に騙されて、庭で優雅に遊ぶ妖精の写真を撮らされたのは有名な話である。

しかし、1980年代に入り、Geoffrey Crawleyという専門家が、フィルム写真の知識を生かし、この事実を直接的に推理した。

この写真が偽物であることは、後に姉妹の一人が自ら認めている。

アーティファクトと常識の狩猟

デジタル写真によって、偽造品や探偵のためのテクニックが豊富になった。

例えば、写真に埋め込まれたメタデータを調べたり、Adobe Photoshopなどのソフトウェアを使って画像の歪みを補正したり、領域を複製して本来の特徴を見えなくするなど、加工された痕跡を探したりするのだ。

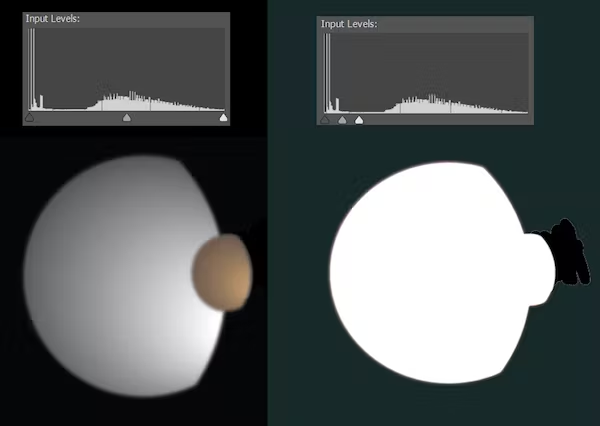

また、デジタル技術による編集は微妙なものだが、ピクセルの明暗を調整することで見えてくることがある。例えば、2010年にNASAが公開した土星の衛星「ディオーネ」と「タイタン」の写真は、決して偽物ではない。この写真は決して偽物ではなく、紛れもない人工物を除去するためにクリーンアップされたもので、陰謀論者の注目を浴びた。

そこで、私はその画像をPhotoshopで加工してみた。下のイラストは、その様子を再現したものだ。

デジタル写真の多くは、カメラで撮影された情報の多くを削除してスリム化したJPEGなどの圧縮形式だ。標準化されたアルゴリズムにより、削除された情報は目に見える影響は最小限に抑えられるが、その痕跡は残る。

画像のどの領域が圧縮されているかは、画像内で何が起こっているか、現在のカメラの設定によって異なる。複数のソースを組み合わせた偽の画像の場合、圧縮の痕跡を慎重に分析することによって、これを検出できることがよくあるのだ。

フォレンジックの方法論の中には、画像の形式とはほとんど関係なく、本質的に視覚的な探偵作業であるものもある。写真に写っている人物は全員同じように照明されているか?影や反射は意味をなしているか?耳や手は適切な場所に光と影を映し出しているか?人の目には何が映っているのか?このシーンを3Dでモデリングしたら、部屋のすべてのラインや角度は正しく再現されるだろうか?と言った内容だ。

Conan Doyleは妖精写真に騙されたかもしれないが、彼の創作したシャーロック・ホームズなら、法医学的写真解析の世界にも馴染むだろう。

人工知能の新時代

テキストから画像への変換を行う人工知能(AI)ツールによって作成された画像の爆発的な増加は、フィルム写真からデジタル写真への移行よりも多くの点で先鋭的である。

私たちは今、文字を入力するだけで、どんな画像でも呼び出すことができる。それは、既存のピクセルの塊を寄せ集めてつくられたラフな画像ではない。内容、品質、スタイルを指定した、まったく新しいイメージなのだ。

これまで、これらの画像を生成するために使用される複雑なニューラルネットワークは、一般に利用できるものが限られていた。これが2022年8月23日、オープンソースの「Stable Diffusion」が一般に公開されたことで、一変した。これで、コンピュータにゲームレベルのNVIDIAグラフィックカードがあれば、研究室や企業がその活動をゲートキーピングすることなく、誰でもAI画像コンテンツを作成することができるようになったのだ。

このことから、多くの人が「ネットで見たものを再び信じることができるのか」と問いかけている。それは場合による。

テキストから画像へのAIは、トレーニング、つまり大量の画像とキャプションのペアを分析することで賢さを身につける。それぞれのシステムの長所と短所は、どのような画像で訓練されたかに由来する部分がある。例えば、ジョージ・クルーニーがアイロンをかけているところを、Stable Diffusionはこのように見ている。

これは現実離れしている。Stable Diffusionが頼りにしているのは、学習した情報だけだ。George Clooneyを見たことがあり、その文字列を俳優の特徴と結びつけることができることは明らかだが、Clooneyの専門家ではない。

しかし、一般的な中年男性の写真はもっとたくさん見て消化しているはずだ。そこで、同じシナリオで一般的な中年男性を求めるとどうなるか、見てみよう。

これは明らかに改善されたが、まだリアルとは言えない。いつもそうだが、手や耳のトリッキーな形状は、フェイクの兆候を探すのに良い場所だ – このメディアでは、不可能な照明の指示ではなく、空間のジオメトリを見ている。

他にも手がかりがあるかもしれない。もし、この部屋を注意深く復元したら、角は四角いだろうか?棚は意味をなしているだろうか?デジタル写真の検査に慣れている法医学の専門家なら、そのあたりを判断できるかもしれない。

もはや自分の目を信じることはできない

テキストから画像への変換システムの知識を拡張すれば、もっといいものができるはずだ。既存のトレーニングを補完するために、自分で記述した写真を追加することができる。このプロセスは、テキスト反転と呼ばれている。

最近、GoogleはDream Boothをリリースした。これは、特定の人物、物体、あるいは芸術様式をテキストから画像へのAIシステムに注入する、より洗練された代替手法である。

この処理には大がかりなハードウェアが必要だが、その結果は驚異的だ。Redditでは、いくつかの素晴らしい作品が共有され始めている。下の投稿にある、DreamBoothに入れられた画像と、Stable Diffusionによるリアルなフェイク画像の写真を見比べてみて欲しい。

私たちはもはや自分の目を信じることはできないが、少なくとも今のところはまだ科学捜査の専門家の目を信じることができるかもしれない。未来のシステムは、専門家を騙すように意図的に訓練される可能性も十分にあるのだ。

私たちは、完璧な写真やビデオさえも一般的になる時代へと急速に移行している。しかし、その一方で、コティングレーの妖精の写真の教訓を思い出す価値がある。

コメントを残す