Google DeepMindとYouTubeは共同で、ミュージシャンやアーティストの創作プロセスを強化するため、音楽用途に特別に設計された生成AIモデル「Lyria」を発表した。

このモデルは、YouTubeと連携して機能し、2つの新しいツールセット「Dream Track」と「Music AI」の基盤となるものだ。これらのツールは、YouTube Shorts用の音楽を作成するためのものであり、クリエイターが口ずさんだメロディから曲を構築するなど、創造的なプロセスを支援することを目的としている。

さらに、Google DeepMindはAI画像を見分ける目的で先日導入された電子透かし技術SynthIDを発展させ、AI音楽にも透かしを埋め込むことが出来る様になった事も発表している。

クリエイターを置き換えるのではなく補助するためのAI

生成AIの台頭は、エンターテインメント分野でも大きな議論を呼んでおり、先日はハリウッドの脚本家組合や俳優組合がストライキを決行するなど、AIによるクリエイターの能力の置き換えが懸念されている。

Google DeepMindとYouTubeが発表した新しいツールの主な目的は、AI音楽を現在のクリエイターの補完として、また音楽としての美的感覚を保ちながら信頼性を維持する技術を作り出すことだ。Googleの過去の研究によると、AIによって生成された音楽は、尺が長くなるほど歪んで現実離れしていく傾向があるということが分かっている。DeepMindは、音楽モデルに入力される情報の複雑さが、ビート、音符、ハーモニーなどをカバーしているため、長い音声シーケンスを生成する際に音楽的な連続性を維持することが困難であると指摘している。

Lyriaモデルは、楽器伴奏とヴォーカルによる質の高い音楽を作るために設計されている。Google DeepMindによると、Lyriaはヘビーメタルからテクノ、オペラまで多くのジャンルに対応している。同社によれば、フレーズ、節、または長いパッセージにわたって、リズム、メロディー、ボーカルの複雑さを維持することができるという。

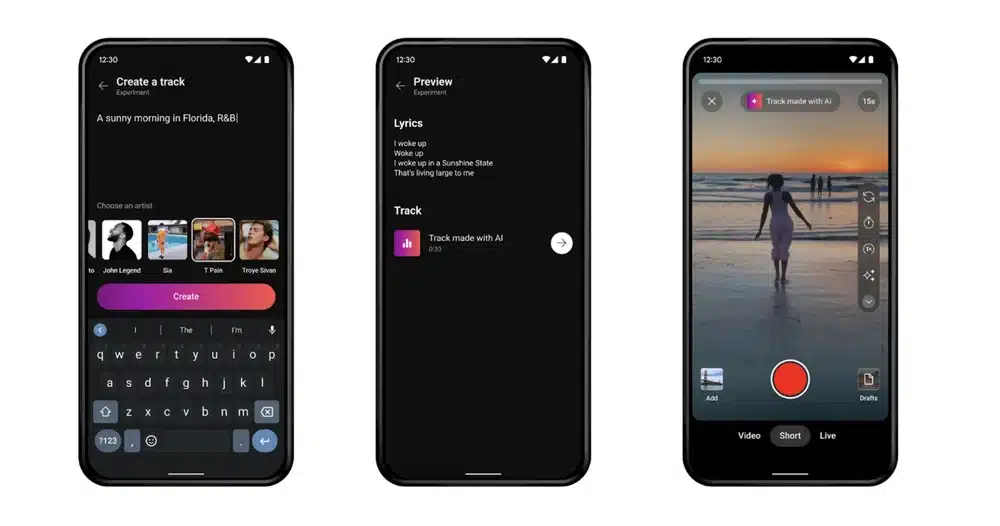

そしてDream TrackはYouTube Shorts向けに提供される。この実験の目的は、アーティストが音楽を作るための新しい方法を探求することだ。当初は、限られたクリエイターに向けて提供され、30秒間のAI生成サウンドトラックを作成することが可能となる。このトラックは、Alec Benjamin、Charlie Puth、Charli XCX、Demi Lovato、John Legend、Sia、T-Pain、Troye Sivan、Papooseなどのアーティストの声と音楽スタイルで作成される。クリエイターはトピックを選択し、アーティストを選んで、歌詞、バッキングトラック、選択したミュージシャンの声を使用して30秒の作品を作成することが出来る様になる。

Music AI Incubatorとのコラボレーションによる、新たな音楽AIツールもYouTubeに登場する。Google DeepMindは、これがカバーする3つの領域を予告している。これには、口ずさんだメロディに基づいて特定の楽器で音楽を作成すること、シンプルなMIDIキーボードで構築したコードを使用して合唱団や他のアンサンブル全体を作成すること、既に持っているボーカルラインのためのバッキングおよびインストゥルメンタルトラックを構築することが含まれる。プロデューサーでありソングライターでもあるLouis Bell氏がサンプルビデオを作成して紹介している。

Music AIツールは今年後半にロールアウトされる予定だ。

DeepmindのSynthIDがAIオーディオに透かしを付ける

Lyriaで生成されたすべてのコンテンツは、Google CloudのVertex AI上でImagenによって生成されたAI画像を識別するために使用されるのと同じ技術ツールキットであるSynthIDでタグ付けされる。

SynthIDは、人間の耳には聞こえず、リスニング体験に影響を与えない方法で、AIが生成したオーディオに透かしを入れる。これは、オーディオ波を、音の周波数スペクトルが時間と共にどのように変化するかを2次元で可視化することによって行われる。

電子透かしは、例えばノイズの追加やMP3圧縮、トラックのスピードアップやスローダウンなど、オーディオ素材が変更されても認識可能なままのようだ。

SynthIDは、曲の一部がLyriaによって作成された場合にも役立つ。Google DeepMindによれば、この「斬新な方法」は、特にオーディオの分野では、これまでにないものだという。

数日前、YouTubeは同プラットフォーム上でAIが生成したオーディオビジュアルコンテンツを扱うための新しいルールを発表した。とりわけ、動画プラットフォームはラベリング要件の強化に重点を置いており、AIコンテンツが人間とAIの両方によって識別されることを望んでいる。

YouTubeにとって、音楽ジェネレーターは、ラベリングを含め、生成されたコンテンツを正確にコントロールできるツールをユーザーに使ってもらうことで、プラットフォーム上のAI生成音楽をよりコントロールできるようにするための戦略的ツールにもなり得るだろう。

Source

- YouTube Official Blog: An early look at the possibilities as we experiment with AI and Music

コメントを残す