Stability AIは、同社の画像生成AIモデルの最新かつ最も強力なバージョンである「Stable Diffusion 3」を発表し、ウェイティングリストへの登録受付を開始した。

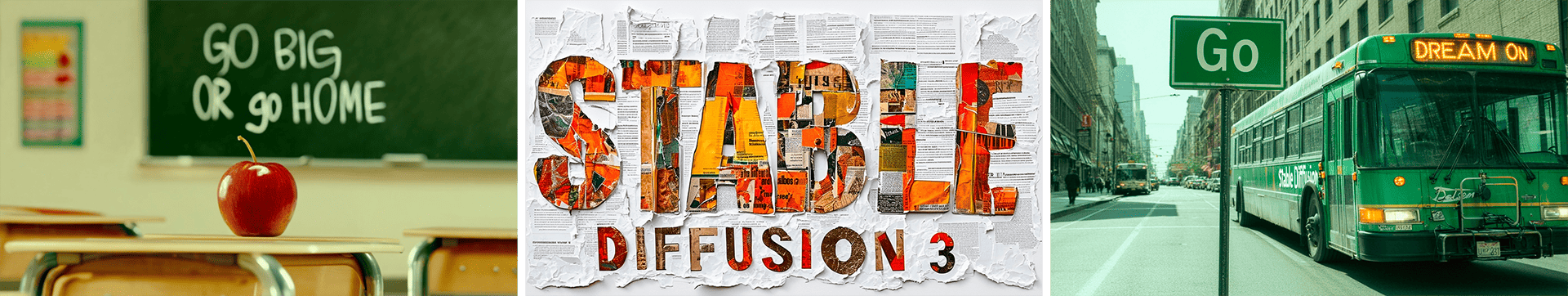

Stability AIは、マルチパート、複雑なプロンプト、画像品質、およびテキスト書き込み機能のパフォーマンス向上を謳っている。

特にテキスト書き込みについては、Stable DiffusionのようなAI画像生成モデルのアキレス腱であった。しかし、Stability AIは、新しい3.0版では、読みやすいテキストのレンダリングと、生成されたビジュアル内の正確なスペルの確保が大幅に改善されると主張している。

特に下記の例では、実際の写真と見分けがつかないようなバスの画像で、道路標識や車両側面の文字も完璧に表現されている。ナンバープレートが歪んで見えるというまだ小さな欠陥はあるものの、全体的なクオリティは以前のモデルから飛躍的に向上している。

Stability AI CEOのEmad Mostaque氏は、Stable Diffusion 3が複雑なプロンプトをいかに正確に実行するかの例をXにて示している。

実際、こうした結果が即座に得られるのか、多くの試行の結果もたらされるのかは不明だが、Mostaque氏によると、この画像はStable Diffusion 3のチューニングされていないベースモデルで生成されたとのことだ。これまでのXでのデモは、このカテゴリーで現在クラス最高であるOpenAIのDALL-E 3よりもさらに優れたプロンプトの追従性を示唆している。

Stable Diffusion 3モデルは、8億から80億のパラメータを持ち、前作から大幅にアーキテクチャを見直した、新たなDiffusion Transformerアーキテクチャ(拡散トランスフォーマー)を含む、近年の新しい画像生成研究を組み合わせたものである。これは、OpenAIが先日公開したSoraモデルに似たもので、オリジナルのStable Diffusionアーキテクチャとは大きく異なっていると、VentureBeatの取材に応じたMostaque氏は述べている。

複雑なデータ分布をよりよくモデル化するためにAIシステムを訓練するための新しい手法である「Flow Matching」のような他の最先端の技術も統合している。Flow Matchingを開発した研究者たちは、従来のDiffusionアーキテクチャと比較して、より高速なトレーニング、より効率的なサンプリング、全体的なパフォーマンスの向上を可能にすると主張している。

Stability AI社によれば、詳細な技術レポートはまもなく発表されるとのことである。

このモデルはまだ一般リリースされていないが、ウェイティングリストが用意されており、ここから申し込むことができる。プレビュー段階は、“オープンリリース”の前にパフォーマンスと安全性を向上させるために使用される、と同社は述べている。

Stability AIは、このモデルが悪用されるのを防ぐため、トレーニングから始まり、テスト、評価、配備に至るまで、数々の安全対策を講じたという。

同社は、モデルの開発と一般利用において、研究者、専門家、コミュニティとの継続的なコラボレーションを重視している。オープンソースで微調整が可能なため、Stable Diffusionモデルは物議を醸すAI画像処理アプリケーションで悪用されやすい。

Stable Diffusionはまた、そのトレーニングデータをめぐって批判され、訴えられたこともある。Stable Diffusion 3では、アーティストは事前にトレーニングデータから何百万もの作品を削除した。Stability AIはStable Diffusion 3の発表でこの問題を回避した。

Stability AIは最近、非常に高速なテキストから画像へのモデルであるStable Cascadeを含む、いくつかの新しいモデルをリリースした。その他の新しいモデルには、動きと一貫性が改善されたAI生成ビデオを生成する生成ビデオモデルであるStable Video Diffusion (SVD)や、テキストから3DへのアプリケーションのためのモデルであるStable Zero123もリリースしている。

Sources

- Stability AI: Stable Diffusion 3

- via VentureBeat: Stable Diffusion 3.0 debuts new diffusion transformation architecture to reinvent text-to-image gen AI

コメントを残す