日本のAIスタートアップである「Sakana AI」は、進化的アルゴリズムを用いて既存のモデルを組み合わせることで新しいAIモデルを自動生成する手法を開発した事を発表した。

Sakana AIの中核となるアイデアは、進化や集合知といった自然界の原理を応用して新しい基盤モデルを生み出すことだ。

目標は、毎回新しいモデルを開発するのではなく、ユーザーが定義したアプリケーション・ドメインに合わせてカスタマイズされたAIモデルを自動的に生成するマシンを開発することだという。

そしてSakana AIは今回、「進化的モデルマージ」と呼ばれる進化にインスパイアされた新しい手法を提案している。これは、多様な能力を持つオープンソースのモデルの大規模なプールから、異なるモデルを「融合(マージ)」して最良の方法を効率的に見つけるために、進化的アルゴリズムを使用するものだ。

このアプローチには2つの方法がある:第一に、異なるモデルのレイヤーをフロー空間で再結合する。第二に、パラメータ空間において異なるモデルの重みを再混合する。進化的アルゴリズムは、可能な組み合わせの広大な空間を探索し、従来の手法や人間の直感では発見が困難な、新しい直感的でない解を見つける。

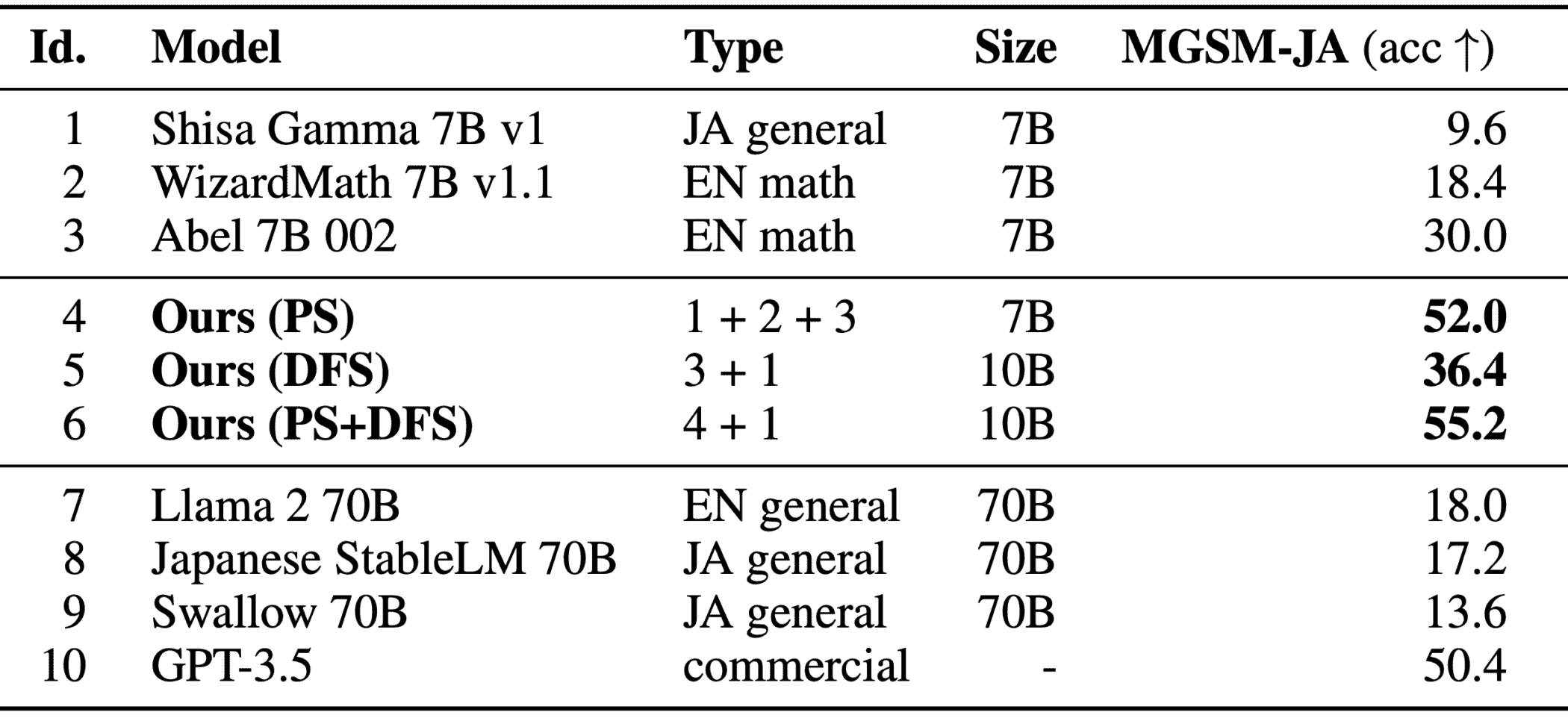

この方法を検証するために、Sakana AIは以下の数学的機能を備えた日本語ラージ言語モデル(LLM)と日本語ビジョン言語モデル(VLM)自動開発した成果を報告している。

- EvoLLM-JP:数学的推論が可能な日本語の大規模言語モデル(LLM)

- EvoVLM-JP:日本語で対話可能な画像言語モデル(VLM)。

- EvoSDXL-JP:高速な日本語画像生成モデル。

驚くべきことに、両モデルとも、いくつかのLLMおよび視覚ベンチマークにおいて、これらのベンチマークで良い結果を出すように明示的に最適化されていないにもかかわらず、最先端の結果を達成したという。

特に、日本語数理LLM「EvoLLM-JP」は、パラメータ数が70億のモデルだが、いくつかの日本語LLMベンチマークにおいて、これまでの700億パラメータの日本語SOTA LLMを上回る性能を示したという。Sakana AIは、この実験的な日本語数理LLMは、汎用的な日本語LLMとして十分に使用できると考えている。

日本語LLMはまた、文化特有の内容を扱うことに著しく優れており、画像とテキストのペアで構成される日本語のデータセットで優れた結果を達成している。

この手法は画像生成のための拡散モデルにも適用できる。Sakana AIは、4つの拡散ステップしか使用しない、高品質で高速な日本語SDXLモデル「EvoSDXL-JP」の開発による予備的な結果を報告している。

Sakana AIは、神経進化、集合知、基盤モデルの組み合わせは、長期的に有望な研究アプローチであると考えている。同社によると、完全にプロプライエタリなモデルに膨大なリソースを投資する前に、増え続けるオープンソースのAIモデルを活用することで、大企業がカスタムAIモデルをより迅速かつコスト効率よく開発できるようになる可能性があるという。

Sakana AIは、これらEvoLLM-JPとEvoVLM-JPをGitHubリポジトリで公開している。また、また、EvoVLM-JPをすぐに試せるデモをHugging Faceで公開している。

Sakana AIは東京を拠点とするスタートアップで、元GoogleのAI専門家であるLlion Jones氏とDavid Ha氏によって設立された。これらのモデルは、テキスト、画像、コード、マルチメディアなど様々な形式のコンテンツを生成するように設計されている。

創設者らは、集合知を持つ自然のシステムに似た、環境の変化に敏感で適応可能なAIシステムを作ることを目指している。これは、不変の構造として設計されることが多い従来のAIモデルとは一線を画すものである。

共同創業者のJones氏は、2017年に発表された有名な研究論文「Attention Is All You Need」の著者であり、今日のAIの成功の多くを支えるディープラーニングの「Transformer」アーキテクチャを築いた巨人だ。Lux CapitalやKhosla Venturesなどの投資家から3000万ドルのシード資金を調達したこのスタートアップは、東京をサンフランシスコのOpenAIやロンドンのDeepMindのようなAIのハブにすることを目指している。

論文

参考文献

- Sakana AI: 進化的アルゴリズムによる基盤モデルの構築

研究の要旨

我々は、強力な基礎モデルの作成を自動化するための、進化的アルゴリズムの新しいアプリケーションを紹介する。モデル結合は、その費用対効果からLLM開発の有望なアプローチとして浮上しているが、現状では人間の直感とドメイン知識に依存しており、その可能性は限られている。ここでは、多様なオープンソースモデルの効果的な組み合わせを自動的に発見することで、この限界を克服する進化的アプローチを提案する。我々のアプローチは、パラメータ空間とデータフロー空間の両方で動作し、個々のモデルの重みを超えた最適化を可能にする。このアプローチは、数学的推論機能を持つ日本語LLMのようなモデルを生成し、クロスドメインマージさえも容易にします。驚くべきことに、我々の日本語数学LLMは、そのようなタスクのために明示的に訓練されていないにもかかわらず、確立された様々な日本語LLMベンチマークにおいて、最先端の性能を達成し、大幅に多くのパラメータを持つモデルをも凌駕した。さらに、本アプローチにより生成された文化認識日本語VLMは、日本文化特有の内容を記述する上で有効であることを実証し、従来の日本語VLMを凌駕した。本研究は、新しい最先端のモデルをオープンソースコミュニティに還元するだけでなく、自動化されたモデル構成のための新しいパラダイムを導入し、基礎モデル開発のための代替的で効率的なアプローチを探求する道を開く。

コメントを残す