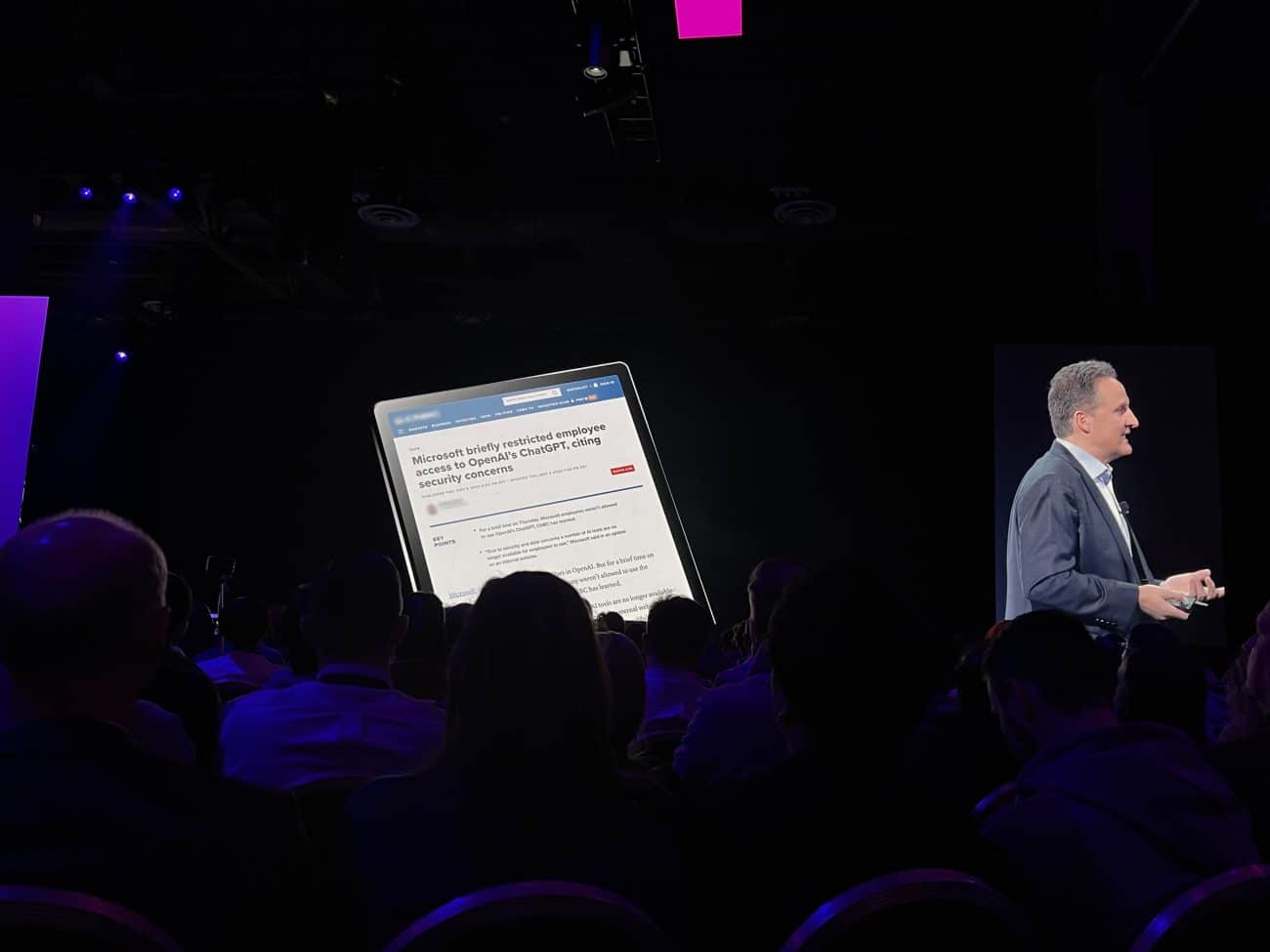

Amazonは、AWSのre:Inventイベントで、OpenAIのChatGPTのセキュリティ上の欠陥を指摘し、それに対抗してAmazon Bedrockが備えるセキュリティと安全機能を紹介した。CEOのAdam Selipsky氏は、CNBCの報告「Microsoft briefly restricted employee access to OpenAI’s ChatGPT, citing security concerns」を引用し、Amazon Bedrockの安全性を高める新機能「Guardrails」を発表した。

Guardlailsは、大規模言語モデル(LLM)の安全性を高めるために設計されており、企業がモデルの使用言語を定義し制限することを可能にし、不適切な回答やブランドに損害を与える可能性のある攻撃的な内容を防ぐことを目的としている。

Selipsky氏は、責任あるAIの重要性を強調し、AWSがそのプラットフォームに最初から統合してきたことを共有した。「責任あるAIの重要な要素は、消費者とアプリケーション間の相互作用を促進し、有害な結果を避けることであり、これを実現する最も簡単な方法は、モデルができることとできないことに制限を設けることです」と、同氏は述べている。

Amazon BedrockのGuardrailsでは、ユーザーはトピックに制限を設け、コンテンツフィルターを適用することができ、アプリケーション内の相互作用から望ましくない有害なコンテンツを排除することができる。これにより、基礎モデル(FMs)に固有のセーフガードを超えた追加の制御層が提供される。

例えば、金融サービス会社が投資アドバイスを提供することを避けたい場合、そのトピックを「拒否トピック」として指定し、モデルが関連する質問に回答しないようにすることができる。また、特定の言葉やフレーズをフィルタリングして、攻撃的なコンテンツを排除することも可能だ。さらに、個人情報(PII)データをフィルタリングして、モデルの回答からプライベートデータを保護することもできる。

Guardrailsは、Amazon BedrockのすべてのLLMに適用でき、これはAmazon Bedrockの微調整されたモデルとエージェントを含む。

Guardrails機能は現在プレビュー段階にあり、来年にはすべての顧客に提供される予定だ。

Source

コメントを残す