NVIDIA CEOのJensen Huang氏は、台湾の台北で開催されたComputex 2023において、同社のGrace Hopper Superchipのフル生産が開始され、複雑なAIプログラムを実行するシステムに搭載することを発表した。

さらに、NVIDIAは新しいMGXリファレンスアーキテクチャを発表した。これは、OEMが新しいAIスーパーコンピューターをより迅速に構築するのを支援し、100以上のシステムが利用可能になることを可能にするものだ。最後に、同社は新しいSpectrum-Xイーサネットネットワーキングプラットフォームを発表した。これは、AIサーバーとスーパーコンピューティングクラスターのために特別に設計され、最適化されているという。

Grace Hopper Superchipの生産

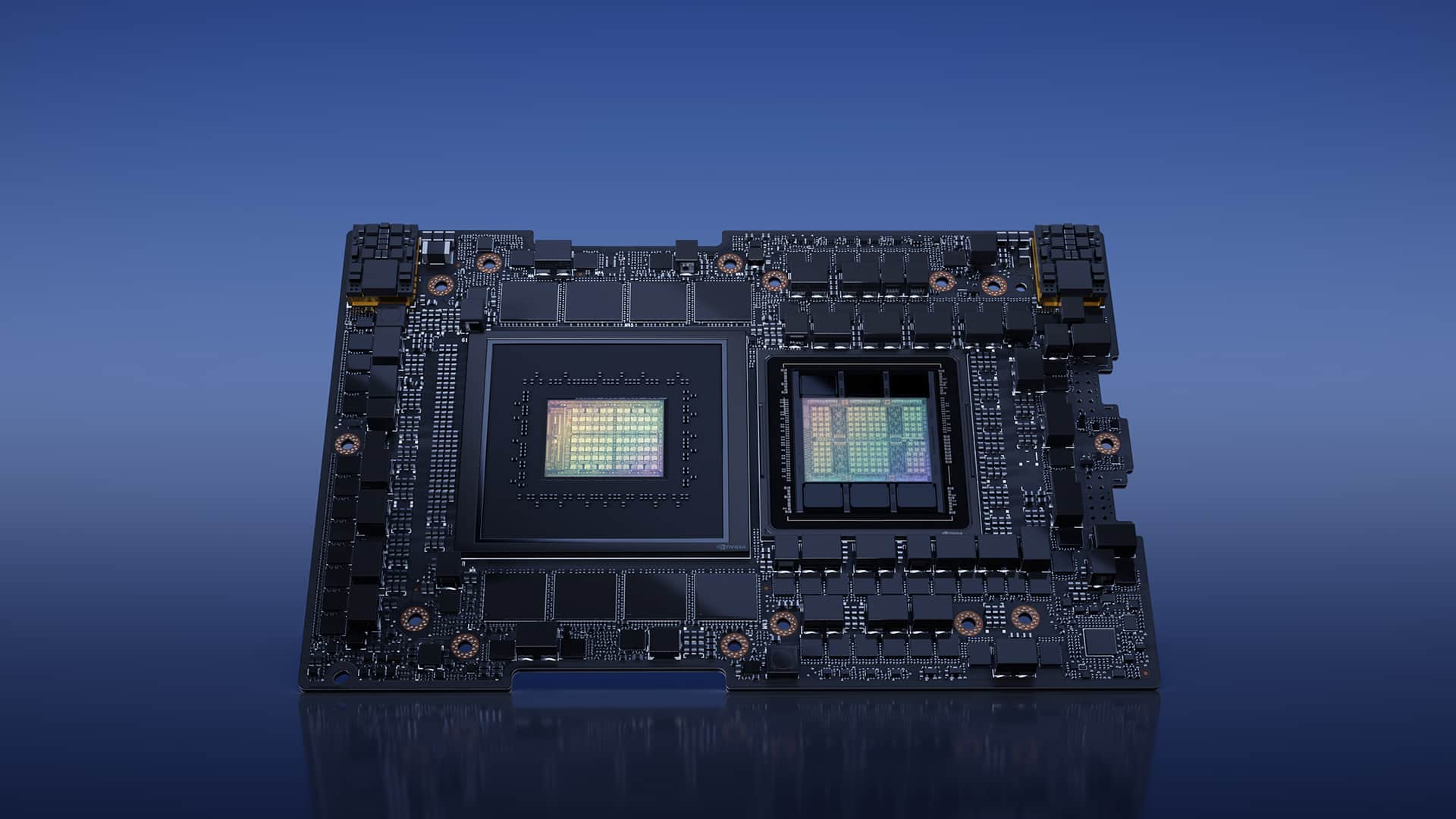

Grace Hopper Superchipは、NVIDIAが今日発表した新しいシステムの中心的な存在だ。ArmベースのNVIDIA Grace CPUと、Hopper GPUアーキテクチャをNVIDIA NVLink-C2Cインターコネクト技術を用いて統合している。Grace 72コアCPU、Hopper GPU、96GBのHBM3、512GBのLPDDR5Xを同じパッケージに組み合わせ、2000億個のトランジスタで構成されている。この組み合わせは、CPUとGPUの間で驚くべきデータ帯域幅を提供し、CPUとGPUの間で最大1TB/sのスループットを提供し、特定のメモリバウンドワークロードに大きな利点をもたらす。

DGX GH200スーパーコンピューター

NVIDIAのDGXシステムは、最も要求の厳しいAIとHPCワークロードのための基準アーキテクチャとしての役割を果たしているが、現在のDGX A100システムは、8つのA100 GPUが一つの協調したユニットとして働くことに限定されている。生成AIの爆発的な成長を受けて、NVIDIAの顧客は、より大きなシステムとより高いパフォーマンスを求めている。DGX H200は、生成AIトレーニング、大規模言語モデル、推奨システム、データ分析などの最大のワークロードに対して、InfiniBandやEthernetなどの標準的なクラスタ接続オプションの制限を回避し、大規模なスケーラビリティを提供することを目指して設計されている。

新しいDGX GH200 AIスーパーコンピュータの細かい点については、まだ詳細が明らかになっていないが、NVIDIAは、36個のNVLinkスイッチを備えた新しいNVLinkスイッチシステムを使用して、256個のGH200 Grace Hopperチップと144 TBの共有メモリを、1個の巨大GPUのように見え、動作するまとまったユニットに結びつけていることが判明している。新しいNVLinkスイッチシステムは、現在第3世代になるNVLinkスイッチシリコンをベースにしている。

DGX GH200は、Grace Hopper CPU+GPUを合計256個搭載しており、NVIDIAのこれまでのNVLink接続のDGX配列で最大の8個のGPUを容易に凌駕し、144TBの共有メモリは、A100 GPU8個間の共有メモリが320GBだったDGX A100システムよりも500倍も多くなっている。また、DGX A100を8GPU以上のクラスタに拡張する場合、システム間のインターコネクトにInfiniBandを採用する必要があり、性能面で不利になる。これに対し、DGX GH200は、NVLink Switchトポロジーを中心にスーパーコンピュータクラスタ全体を構築した初めての例であり、NVIDIAは、前世代のシステムと比較してGPUからGPUへの帯域幅が最大10倍、CPUからGPUへの帯域幅が7倍となるとしている。また、競合するインターコネクトよりも5倍のインターコネクト電力効率(PJ/bitで測定されると思われる)を実現し、最大128TB/秒の2分割帯域幅を提供するように設計されている。

MGXシステムリファレンスアーキテクチャ

NVIDIAの新しいMGXリファレンスアーキテクチャは、AI中心のサーバーデザインに直面するOxMパートナーの新たな課題を解決し、設計と展開を加速することを目指している。MGXシステムは、NVIDIAのCPUとGPU、DPU、ネットワーキングシステムのポートフォリオ全体をカバーするモジュラーなデザインを採用していますが、今日のサーバーに見られる一般的なx86とArmベースのプロセッサに基づくデザインも含まれている。

Spectrum-Xネットワーキングプラットフォーム

NVIDIAのMellanoxの買収は、同社がネットワーキングコンポーネントとソフトウェアをAI中心のニーズに合わせて最適化し、調整することができるようになったため、同社にとって重要な動きとなった。新しいSpectrum-Xネットワーキングプラットフォームは、その能力の完璧な例であり、NVIDIAはこれを「AI向けの世界初の高性能イーサネット」ネットワーキングプラットフォームと称している。

GraceとGrace Hopper Superchipのスーパーコンピューティング

NVIDIAの初のArm CPUであるGraceはすでに生産に入り、最近のスーパーコンピューターの勝利に影響を与えている。これには、台湾の国立高性能計算センターのためにコンピューティングベンダーASUSが構築する新たに発表されたTaiwania 4が含まれる。このシステムは44のGrace CPUノードを特徴とし、Nvidiaは、デプロイされたときに、それがアジアで最もエネルギー効率の良いスーパーコンピューターの一つになると主張している。このスーパーコンピューターは、気候変動問題をモデル化するために使用される。

Source

コメントを残す