Stable Diffusionを開発するStability AIは、来るStable Diffusion 3.0のリリースに向けて、アーティストが希望する場合は、AIのトレーニングデータセットから自身の作品を削除出来るようになると発表した。

これに先立ち、アーティストの権利を守るために成立された団体である、「Spawning」が、AIによって自身の作品が学習に利用されたアーティストが、それを拒めるように、作品の情報を登録できる「Have I Been Trained?」と言うサイトを立ち上げていた。Spawningは、Stability AIにこのサイトの情報を用いて、オプトアウトの要求を行ってきたが、これに対する、Stability AIとしての正式な対応となる。しかし、これが実際にどのように実施されるかはまだ不明だ。

Stable DiffusionやDALL・Eと言った、AI画像合成モデルは、これまでに画像の権利所有者の許可を求めることなく、インターネット上に公開された大量の画像をスクレイピングして得られた大規模なデータセットから学習することで、画像を生成する能力を獲得した。画像生成AIに限らず、先日発表されて話題となっている、OpenAIのChatGPTなども、インターネット上に公開されている文書などを権利者の許諾なく利用し、学習することで人間のような文書を制作する能力を獲得した。これに対する倫理的・法的な議論はもちろん各地で噴出しており、実際にGitHubのAI「Copilot」は既に訴訟を起こされている。

そしてつい数日前に発表された新たな研究(まだ査読を受けていない)では、Stable Diffusionを含む画像生成モデルが、著作権で保護された画像を含む公共のインターネットデータから学習するのみならず、実際に画像を生成する際には元の作品の一部をコピーして利用しているケースが確認されている。倫理的な火種はくすぶっているように思われる。

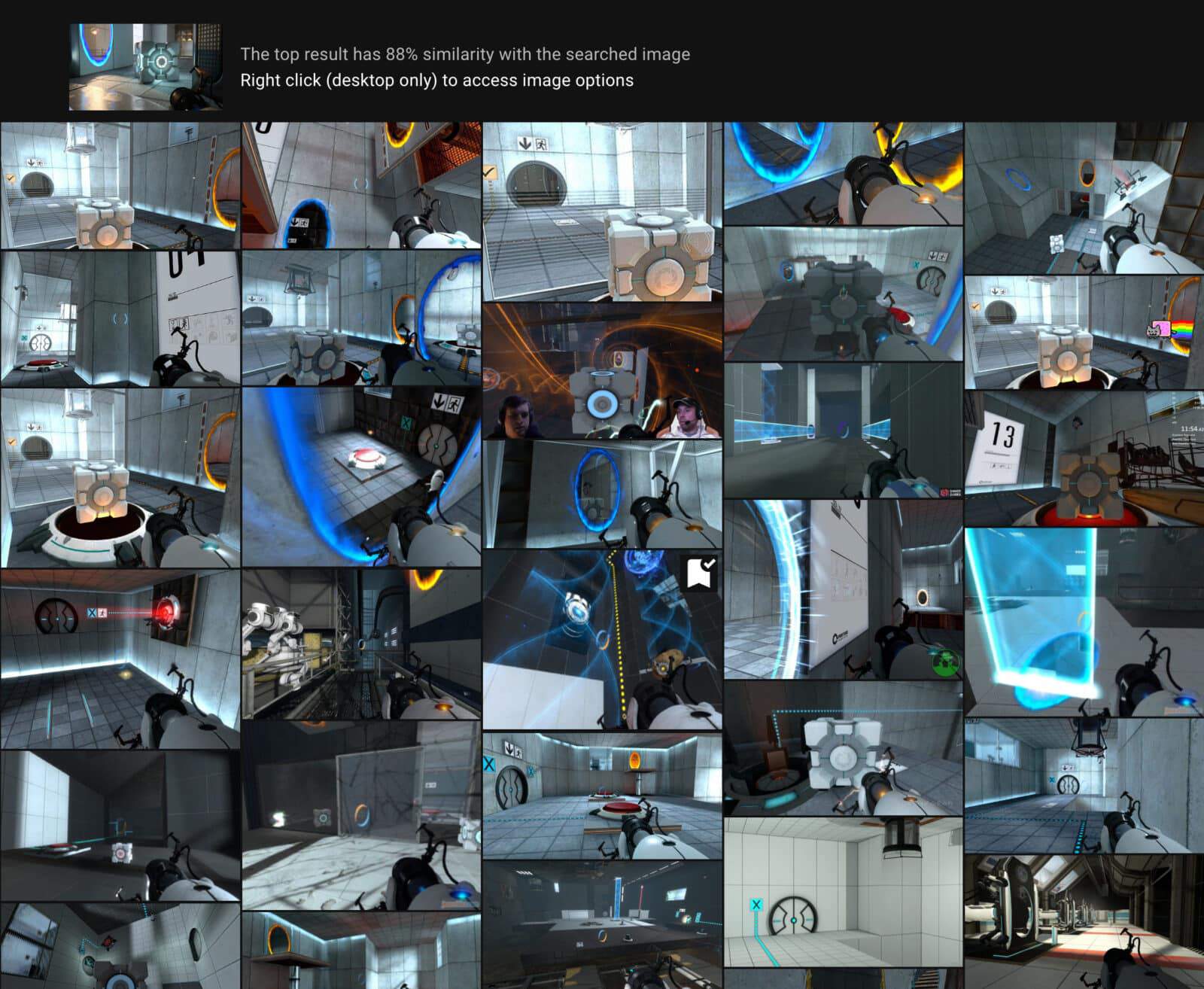

今回の、Have I Been Trained?が実際にどのように動作するのか、適当な画像をアップロードして確かめてみた。

アップロードすると、検索エンジンが大規模AIオープンネットワーク(LAION)画像データベースで一致するものを見つけて一覧表示してくれる。サインインすることで、これら一覧で表示された物の中から、オプトアウトして欲しい作品を選び、リクエストを送ることが出来る様だ。

ただし、実際にアカウントを登録するとは言っても、メールアドレスとパスワードを登録するのみで、身元を確認する動きも、作品との関係や実際の所有権の確認などもなかった。

と言う事は、実際にオプトアウトの要求を行った人がその作品に対する所有権を持っているのか、法的に確認するための膨大な作業を誰が行うのかという問題が発生してくる。Stability AIのCEOは、法的に画像の使用に許可は必要ないと言っている事から、同社にこれを託すことは出来そうもない。

また問題として、画像が既にLAIONのデータセット内に存在しており、このHave I Been Trainedにて検索可能である必要がある。そして、これから発表される作品などをあらかじめオプトアウトしておく方法は今のところ提示されていない。

そもそも、生成AIのオプトアウトプロセスが欧州の一般データ保護規則(GDPR)における同意の定義に当てはまらないという指摘もあり、同意はデフォルトで想定されるものではなく、積極的に与えられなければならないとする意見もある。これに沿って、プロセスはオプトインのみとし、デフォルトですべてのアートワークをAIトレーニングから除外するべきだという根本的なあり方を見直すように求める声も少なくないようだ。

今のところ、この動き自体はアーティスト自身の作品に対する姿勢を鮮明にすると言うパフォーマンス的な側面を出ず、実行力の伴わないものである様に思われる。ただし、AIが生成したアートに対してネット上で大規模な抗議活動が行われていることに対し、Stability AI自身は倫理的な議論を認識するための動きも見せている。

コメントを残す