AIスタートアップのrabbitは、199ドルのスタンドアローンAIデバイスである「rabbit r1」を発表した。

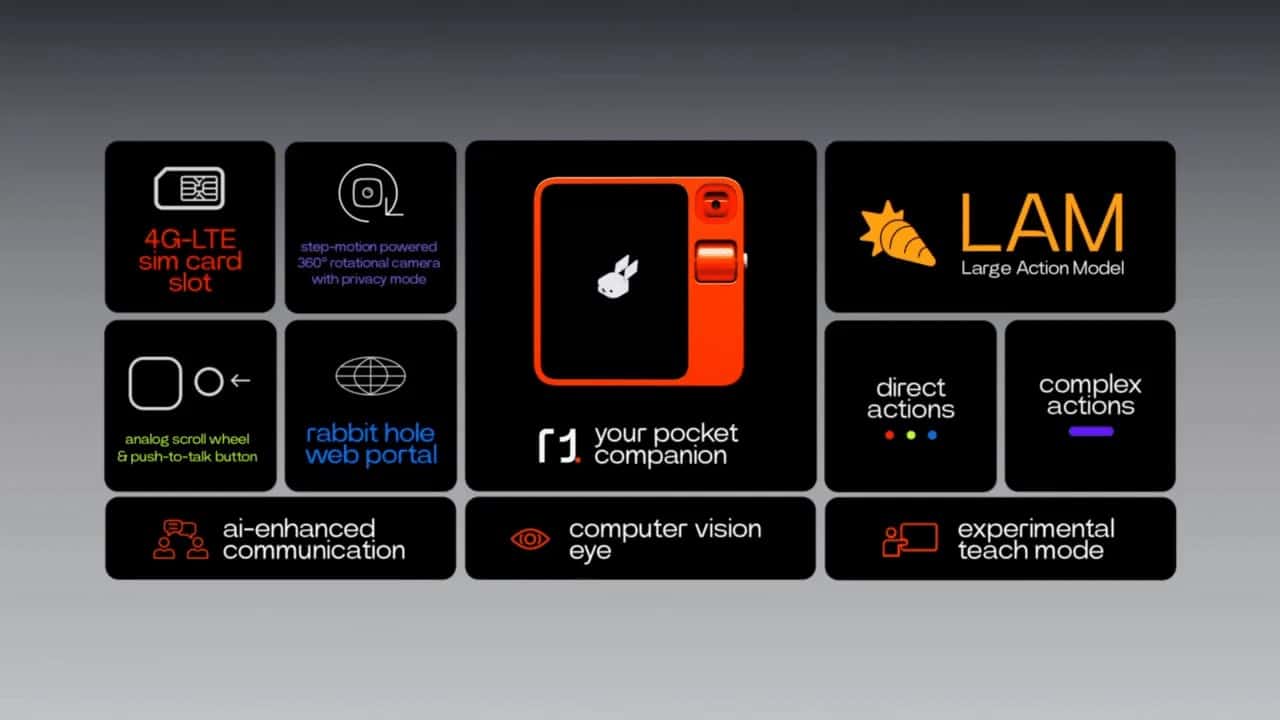

r1は、SiriやChatGPT、同様のシステムで使われている大規模言語モデル(Large Language Model)に似た名前である「Large Action Model(LAM)」を搭載している。これは、SpotifyやUberなどのアプリを操作する人々のインタラクション・データで訓練されており、これによってr1は、ユーザーからのコマンドを受け取り、ユーザーに代わってアプリ内の指示を実行する事が出来るという。

rabbitは、LAMは、AlexaやGoogleアシスタントのようにネイティブアプリのサポートに頼ることなく、既存のアプリケーションと対話することが可能になると考えている。このハイブリッド・アプローチは、ニューラルネットワークのパターン認識とシンボリックAIの推論を組み合わせたもので、その結果、多用途で適応性の高いAIアシスタントを実現している。赤い見た目のデバイスの外観も目を引くが、r1の真の主役はLAMと言える。

LLMのように、LAMはプリインストールされたrabbit OSを介して自然言語で簡単にコントロールできる。言ってみれば、r1は、音楽をかけたり、交通機関を注文したり、買い物をしたり、メッセージを送ったりといったタスクをインターネット上で必要に応じて実行する次世代AIアシスタントのためのハードウェアなのだ。これまでと大きく異なるのは、LAMが人間用に設計されたユーザー・インターフェースを操作できるため、r1は特別なインターフェースを必要としない。そのため、理論的にはこのデバイスは人間が操作出来ることならどんなアプリにも使用できると考えられている。

また、r1には特別なトレーニングモードがあり、ユーザーがデバイスに特定の動作を教えることができる。rabbit OSは、Photoshopのような複雑なアプリケーションのマルチステップタスクを学習し、音声コマンドで実行することもできるという。

すべてのデータはアプリ自身で処理されるため、デバイス自体はデータを収集するようには設計されていない。もちろん、rabbit OSを通じてWebアカウントにログインする必要がある。

rabbit r1のスペック

rabbit r1はTeenage Engineeringと共同開発された。iPhoneの約半分のサイズで、2.3GHz MediaTekプロセッサー、4GBのRAM、128GBのストレージを搭載している。

2.88インチのタッチスクリーン、回転カメラ、スクロールホイール/ナビゲーションボタンを搭載し、デバイス上で直接操作することも、遠距離マイクを介して音声で操作することもできる。

rabbit CEOのJesse Lyu氏によると、r1のビジョンは音声アシスタント、スクリーン、カメラを組み合わせたものだという。iPhoneよりもむしろ、Humaneの新しいAI Pinのようなデバイスと競合する可能性が高いとLyu氏は言う。Alexaのようなスマートアシスタントは、r1と比べると時代遅れだとLyu氏は言う。

R1は同社のWebサイトから予約注文が可能で、3月に出荷される予定だ。価格は199ドルとなっている。

Source

コメントを残す