Samsungは、急激に需要が拡大したAI関連半導体に希望を見出しており、不振を極めるメモリチップ市場において、突出した需要を記録している高帯域幅メモリ(HBM)への投資を拡大するようだ。報道によると、Samsungは今年中にAI用途のHBMチップを量産する準備を進めているという。

The Korean Timesによると、Samsungは2023年後半にAI用HBMチップの量産を計画しており、AI用メモリー半導体市場で急速に主導権を握ったSK hynixに追いつくつもりだという。

TrendForceによると、2022年のHBM市場におけるSK hynixのシェアは約50%、Samsungは約40%だった。残りの10%はMicronが占めている。しかし、HBM市場全体はそれほど普及しておらず、DRAM分野全体の1%程度に過ぎない。

とはいえ、AI市場の成長とともにHBMソリューションの需要は増加することが予想され、Samsungは現在、こうした市場の変化を見越してSK hynixに追いつき、HBM3チップを量産する意向だ。AI時代が本格化するにつれ、HBM製品の需要は劇的に増加する可能性がある。

SamsungのHBM3ソリューションは、複数のDRAMチップを垂直に積み重ね、16GBと24GBの容量がある。HBM3の最高速度は6.4Gbpsに達する。

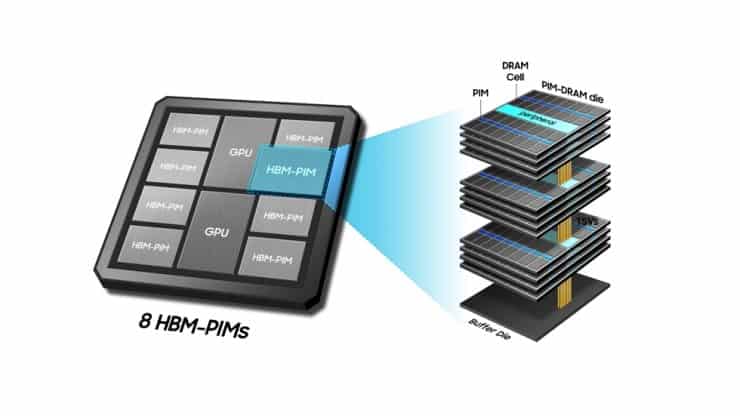

HBMに加え、Samsungは、AI処理能力と統合された広帯域メモリチップであるHBM-PIMや、DRAM容量の限界を克服できるCXL DRAMなどの新しいメモリソリューションを導入し続けている。

KB証券のアナリスト、Kim Dong-won氏は、SamsungがHBM市場に新製品を投入することで、低迷するメモリーチップ市場に対して収益性を高めることが期待できると述べた。

「今年の第4四半期から、Samsungは北米のGPUメーカーにHBM3の供給を開始する見込みである。その結果、SamsungのDRAM総売上高に占めるHBM3のシェアは、2023年の6%から2024年には18%に拡大すると予想される」と分析している。

Sources

- The Korean Times: Samsung going after SK hynix in AI memory chips

コメントを残す