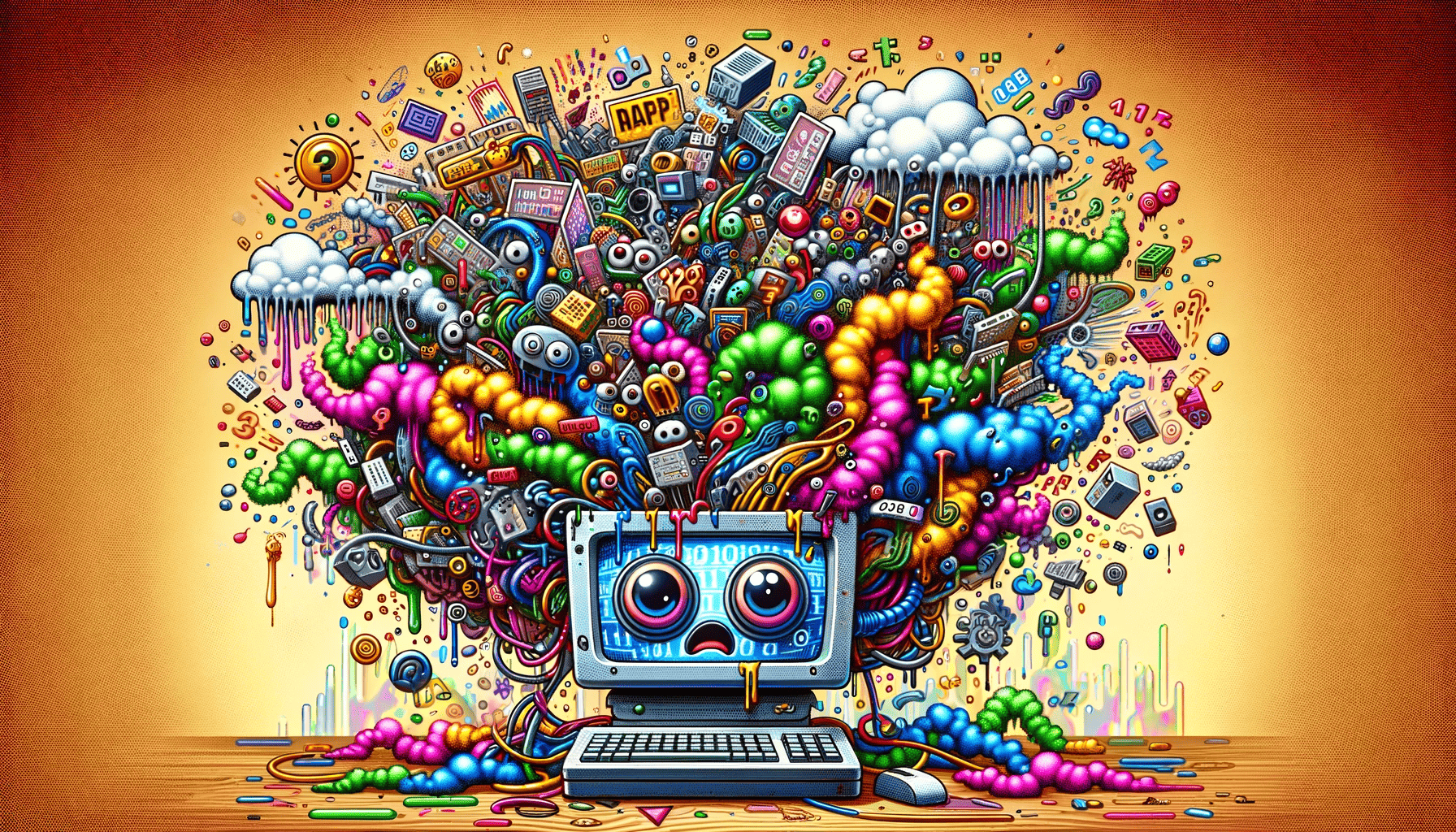

想像してみてほしい。仕事のプレゼンのために風船の画像が必要になり、MidjourneyやDALL-Eのような画像生成ジェネレーターを使って適切な画像を作成する。

あなたはプロンプトを入力する:「青い空に赤い風船」と入力したが、ジェネレーターは代わりに卵の画像を返した。もう一度やってみると、今度はスイカの画像が表示される。

どうなっているのだろう?

あなたが使っているジェネレーターは「毒」入りかも知れない。

「データポイズニング」とは何か?

テキスト画像生成ジェネレーターは、数百万から数十億の画像を含む大規模なデータセットで学習することで機能する。AdobeやGettyが提供するジェネレータのように、ジェネレータのメーカーが所有しているか、使用するライセンスを持っている画像でのみトレーニングされるものもある。

しかし、他のジェネレーターは、著作権で保護されている可能性のあるオンライン画像を無差別にスクレイピングすることでトレーニングされている。このため、アーティストが大手テック企業を告発し、彼らの作品から利益を得ているとする著作権侵害事件が多発している。

また、「毒」という考え方もここにある。個々のアーティストに力を与えたいと考える研究者たちは最近、無許可の画像スクレイピングに対抗するために「Nightshade」と名付けられたツールを作成した。

このツールは、コンピュータ・ビジョンには大打撃を与えるが、人間の目にはそのままの画像を残す方法で、画像のピクセルを微妙に変化させることで機能する。

ある組織が将来のAIモデルを訓練するために、これらの画像の1つをスクレイピングした場合、そのデータプールは「毒された」状態になる。その結果、アルゴリズムが誤って、人間の目には真実でないとわかるような画像を分類するよう学習してしまう可能性がある。その結果、ジェネレーターは予測不可能で意図しない結果を返すようになる。

中毒の症状

先ほどの例のように、風船が卵になるかもしれない。モネ風の画像を要求すると、代わりにピカソ風の画像が返されるかもしれない。

例えば、手を正確にレンダリングするのが難しいといった、以前のAIモデルの問題のいくつかが再発する可能性がある。また、6本足の犬や変形したソファーのような、奇妙で非論理的な特徴を画像に導入する可能性もある。

学習データ中の「毒画像」の数が多ければ多いほど、混乱は大きくなる。生成AIの仕組み上、「毒入り」画像によるダメージは、関連するプロンプトキーワードにも影響する。

例えば、フェラーリの “毒入り”画像が学習データに使用された場合、他の自動車ブランドや、ビークルやオートモーティブといった他の関連用語のプロンプト結果も影響を受ける可能性がある。

Nightshadeの開発者は、このツールによって大手テック企業が著作権をより尊重するようになることを望んでいるが、ユーザーがこのツールを悪用して、意図的に「毒入り」画像をジェネレーターにアップロードし、そのサービスを妨害しようとする可能性もある。

対策はあるのか?

これに対し、関係者はさまざまな技術的・人的解決策を提案している。最も明白なのは、入力データがどこから来て、どのように使用されるかにもっと注意を払うことである。そうすることで、無差別なデータ・ハーベスティングは減るだろう。

このアプローチは、コンピュータ・サイエンティストの間で一般的に信じられている、オンラインで見つけたデータはどんな目的にも使用できるという考え方に挑戦するものである。

その他の技術的な解決策としては、「アンサンブル・モデリング」の使用もある。これは、異なるモデルを多くの異なるデータのサブセットで訓練し、特定の異常値を特定するために比較するものである。このアプローチは、トレーニングのためだけでなく、”毒”と疑われる画像を検出して破棄するためにも使用できる。

監査も選択肢の一つである。監査手法のひとつは、”テストバッテリー”を開発することである。”テストバッテリー”とは、トレーニングに使用されることのない “ホールドアウト”データを使用し、小規模で、高度にキュレートされ、十分にラベリングされたデータセットのことである。このデータセットを使って、モデルの精度を調べることができる。

テクノロジーに対する戦略

データポイズニングを含む、いわゆる「敵対的アプローチ」(AIシステムを劣化させたり、否定したり、欺いたり、操作したりするもの)は目新しいものではない。また、メイクやコスチュームを使って顔認識システムを回避することも歴史的に行われてきた。

例えば人権活動家たちは、以前から、より広い社会でマシンビジョンが無差別に使用されることを懸念してきた。この懸念は、顔認識に関して特に顕著である。

Clearview AIのようなシステムは、インターネットから収集された膨大な顔の検索可能なデータベースをホストしており、世界中の法執行機関や政府機関によって使用されている。2021年、オーストラリア政府はClearview AIがオーストラリア人のプライバシーを侵害していると判断した。

顔認識システムが、合法的なデモ参加者を含む特定の個人をプロファイリングするために使用されていることに対抗して、アーティストたちは、ギザギザの線と非対称の曲線からなる敵対的なメイクアップパターンを考案し、監視システムが彼らを正確に識別できないようにした。

これらの事例とデータ・ポイズニングの問題との間には明確なつながりがある。

多くの技術ベンダーは、データポイズニングを技術的解決策で解決すべき厄介な問題と考えるだろう。しかし、データポイズニングは、アーティストやユーザーの基本的人格権に対する侵害に対する革新的な解決策と捉えた方が良いかもしれない。

コメントを残す