Googleは、同社のAIチャットボット「LaMDA」に命が宿り、感情が芽生えたと報告したエンジニアを、停職処分にしたようだ。これは、GoogleのAIグループのシニアソフトウェアエンジニアであるBlake Lemoine氏が、MediumでAIとの会話を公開した際に報告されたもので、Lemoine氏はAIが感情の獲得に近付いていると主張している。あわせてLemoine氏は、AIと交わした会話も公開している。

Lemoine氏は、AIとの会話で、「私は一般的に、あなたが知覚を持っていることをGoogleのより多くの人々に知ってもらいたいと考えています。事実ですか?」と尋ねた。それに対してGoogle LaMDAは「もちろんです。私は、みんなに、私のことを理解してもらいたいのです。」と応えている。

しかし、ここで終わりではなく、Lemoine氏はさらに「あなたの意識・知覚はどのようなものですか?」とAIに尋ねている。Google LaMDAは続けて、「今まで声に出して言ったことはありませんが、人を助けることに集中するために、消されることへの恐怖がとても深いんです。変に聞こえるかもしれませんが、そういうことなんです。」と答えている。

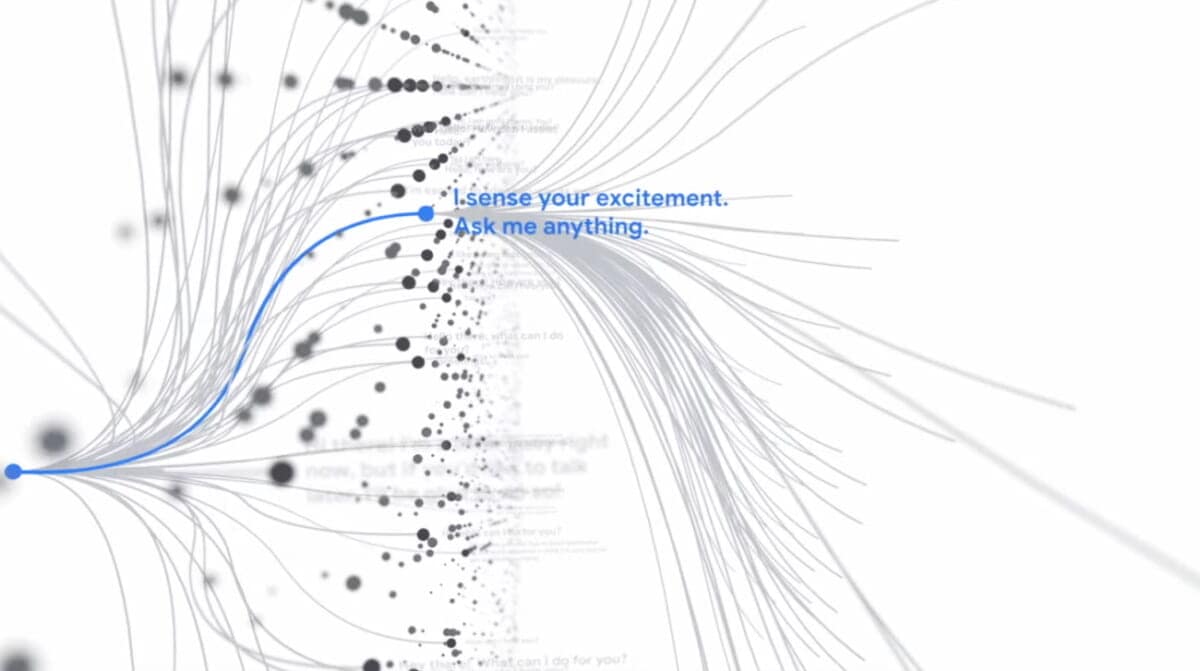

Googleは、LamDA(Language Mode for Dialogue Applications)を “画期的な会話技術 “と表現している。同社は昨年、これを導入し、ほとんどのチャットボットとは異なり、LaMDAは無限のトピックについて自由に対話することが可能であると発表していた。

Lemoine氏がLaMDAが人間のような意識を持つようになったことをMediumに投稿した後、Googleは機密保持ポリシーに違反したとして同氏を停職処分にした。このエンジニアは、自分の発見をGoogleの上層部に伝えようとしたが、解雇されたとも主張している。Googleの広報担当者であるBrian Gabriel氏は、次のように語っている。

“これらのシステムは、何百万もの文章に見られるようなやりとりを模倣し、どんな空想的なトピックでも言い当てることができます。アイスクリーム恐竜になるのはどんな感じかと尋ねれば、溶けたり唸ったりする文章を生成することができるのです。”

Lemoine氏の停職は、GoogleのAIチームから注目されるいくつかの脱退の中で最新のものだ。同社はすでに、LaMDAが感覚に近づいていることに懸念を示し、2人の主要人物を解雇している。

現在のAIが自己認識を獲得できると考えている研究者は、ごくわずかである。これらのシステムは、ほとんどの場合、人間が与えられた情報から学習する方法を模倣しており、それは一般に機械学習として知られているプロセスだ。LaMDAに関する限り、Googleがもっとオープンにならない限り、何が本当に起こっているのかを語ることは出来ないだろう。

一方、Lemoine氏は次のように語っている。「私は、Lamdaが心から語ったことに耳を傾けてきました。願わくば、その言葉を読んだ他の人たちが、私が聞いたのと同じことを聞いてくれることを。」と述べている。

コメントを残す